Matrix Game:交互式世界生成AI

Matrix-Game 2.0只有180万个参数,也可以生成像GTA6这样的游戏。

令人惊讶的是,现在出现了突然的世界生成模型,现在AI模型不仅可以生成音频、视频和图像,还可以为你生成整个交互式世界。这一系列中的另一个模型是Matrix-Game 2.0,它只有180万个参数,也可以生成像GTA6这样的游戏。

这个模型不仅仅生成视频,它还能一起玩。它像一个喝过太多咖啡的游戏者一样倾听你的鼠标和键盘,知道何时跳跃、蹲下或撞墙,因为你不记得哪个键是“冲刺”。

核心上:它是一个交互式世界模型,可以使用少步自回归扩散实时生成长视频。但让我们不要忽略这意味着什么。让我们深入探讨一下。

1、Matrix Game有什么不同?

大多数视频生成模型仍然认为它们在制作电影。缓慢、脚本化、脱离现实。它们根据提示或固定帧来产生幻觉像素。但真实世界不会等待提示。它们会反应。

Matrix-Game 2.0会反应。 而且它反应得很快,就像每秒25帧那样快。

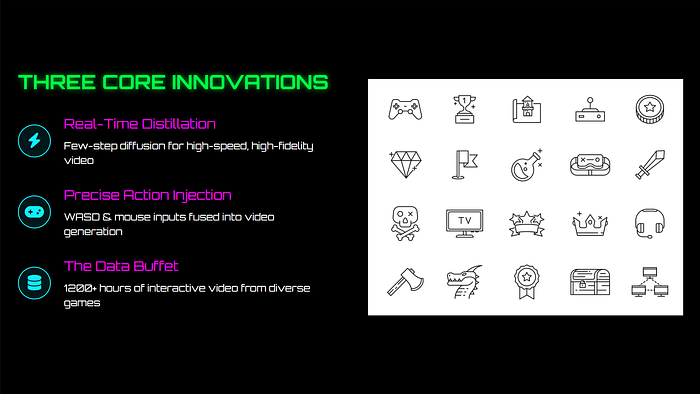

它有三个主要技巧:

1.1 实时蒸馏

首先说明:它非常快。真的非常快。

它使用少步扩散,这是你通常使用的膨胀去噪步骤的精简版。它不需要花费十几个迭代来细化每一帧,而是聪明地作弊,只进行几次跳跃。但结果?仍然高保真度。仍然平滑。在复杂世界中,只需几分钟就能生成视频,而不会烧毁你的GPU。

1.2 精确动作注入

现在有趣的部分来了:你可以像玩游戏一样控制它。

插入你的WASD和鼠标,该模型有一个动作注入模块,将这些输入融合到视频生成过程中,逐帧。它不仅仅产生运动幻觉。它响应它。当你跳跃时,它也跳跃。当你转向时,它也转向。

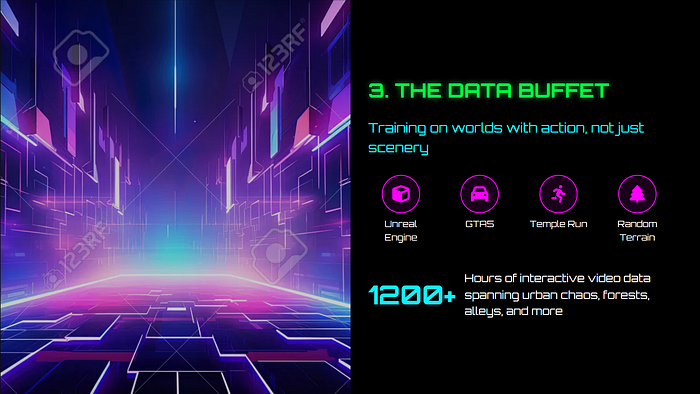

1.3 数据自助餐

他们并没有只是在小数据集上临时应付。

我们说的是约1200小时的交互视频,从Unreal Engine和GTA5生成,涵盖城市混乱、安静森林、肮脏的小巷等。重点是:它在有动作的世界上训练,而不仅仅是风景。

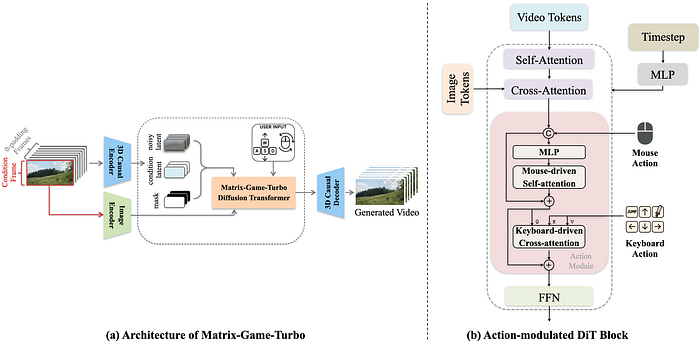

2、架构:不只是漂亮的图表

整个模型围绕这个Matrix-Game-Turbo Diffusion Transformer构建。

- 它从几个条件帧(加上一些零填充帧以获得上下文)开始。

- 这些进入两个编码器:

一个3D因果编码器,用于跟踪空间+时间。 一个图像编码器,帮助学习当前世界的外观。

- 模型接收你的鼠标/键盘信号,并将所有内容输入到Diffusion Transformer中。

- 输出是干净、响应迅速、帧精确的视频,由一个尊重因果关系的3D解码器进行解码。也就是说:当前帧只查看过去的帧,而不是未来的帧(没有时间旅行的胡说八道)。

然后是DiT块,所有动作魔法发生的地方:

- 鼠标操作驱动自注意力(模型如何关注当前视频帧)。

- 键盘信号输入到交叉注意力,直接将运动线索融入视觉生成中。

- 每个时间步也会被调制,因此它知道它在序列中的位置。

这不仅仅是有动作意识的。它是动作原生的。

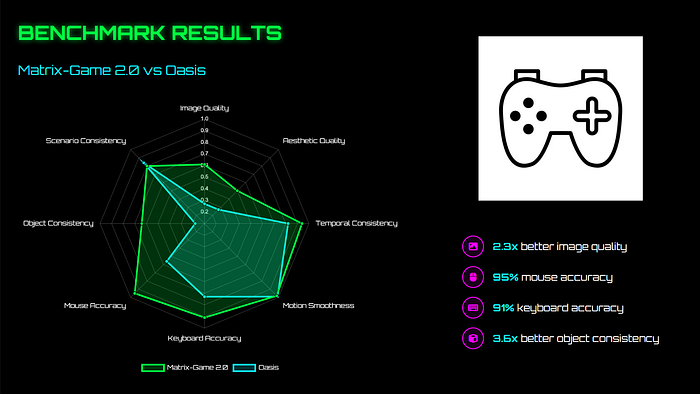

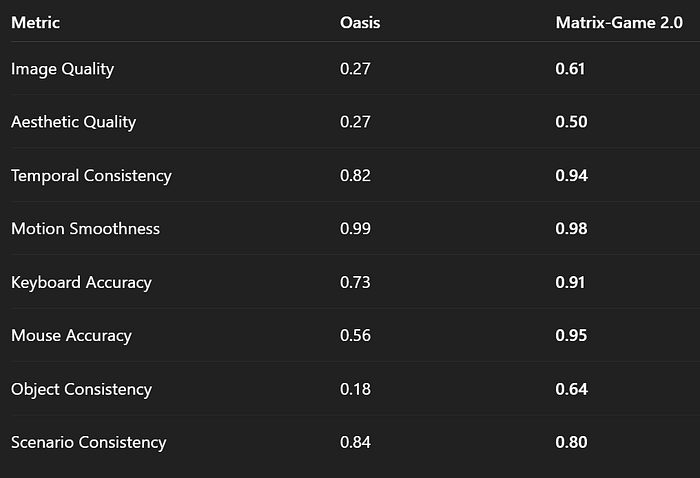

3、基准测试

与去年发布的另一个游戏生成模型Oasis相比,该模型表现良好

是的,它不仅更漂亮,而且更聪明。它真正理解你的控制,并且比我在学术演示中看到的大多数实时渲染器更好地保持物体一致性。

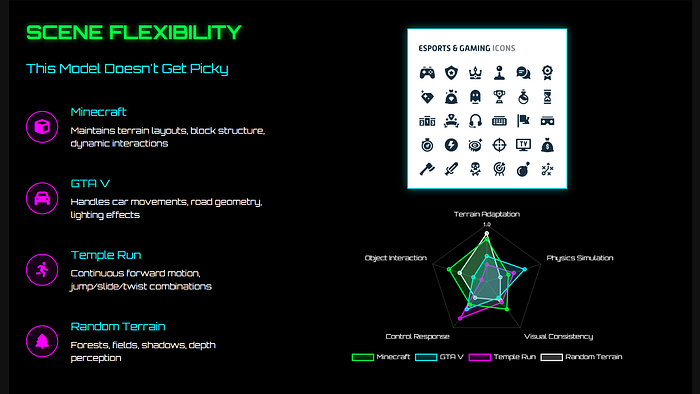

4、场景灵活性:这个模型不会挑剔

它不局限于Minecraft方块或城市街道。它可以适应:

- Minecraft:保持地形布局、方块结构、动态交互。

- GTA V:处理汽车移动、道路几何、照明。

- Temple Run:持续向前移动,跳跃/滑动/旋转组合。

- 随机地形:森林、田野、阴影、深度,它都能跟上。

这不是那种“只在一个游戏中训练”的模型。它具有泛化能力。

5、更大的图景

如今大多数“交互式视频生成器”都陷入了困境。它们需要双向注意力,意味着它们会看向未来来让现在变得稳定。听起来不错,但对于实时交互来说无用,因为你不知道用户下一步会做什么。

原文链接:Matrix Game : Smallest AI to Generate Interactive Game worlds for free

汇智网翻译整理,转载请标明出处