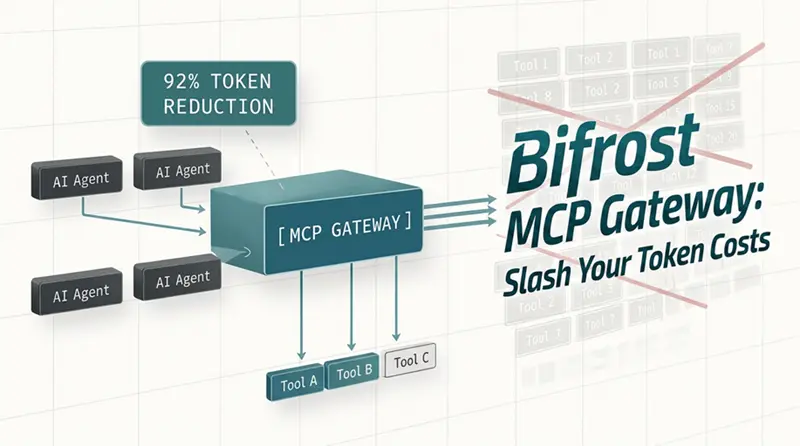

Bifrost MCP网关:Token降本神器

如果你一直在用模型上下文协议(MCP)构建人工智能代理,你可能已经注意到一些不舒服的事情。你连接的工具越多,每次请求的费用就越高,即使大多数工具根本没有被使用。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

如果你一直在用模型上下文协议(MCP)构建人工智能代理,你可能已经注意到一些不舒服的事情。你连接的工具越多,每次请求的费用就越高,即使大多数工具根本没有被使用。

这不是配置问题。这是经典MCP工作方式的基本问题。而且它会被悄悄忽略,直到账单通知到来。

Bifrost的MCP网关就是为了解决它而构建的,这就是实际发生的情况,他们如何修复的,为什么基准数据值得注意。

1、什么导致了成本问题?

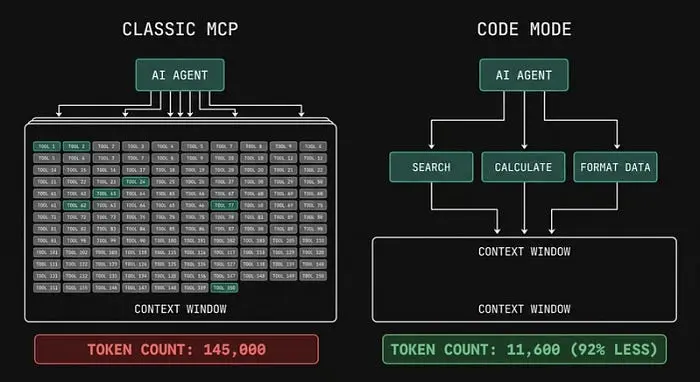

经典MCP有一个直接但昂贵默认行为,即每个连接的服务器的每个工具定义都会被注入到每次请求的模型上下文中。

让我们算一算。连接5个MCP服务器,每个有30个工具,你在提示开始之前就发送了150个工具定义。连接16个服务器,总共约500个工具,这个数字会进一步增加,在每个代理循环的每一轮都被消耗,不管模型实际需要哪些工具。

在这种规模下,代币成本不是四舍五入的误差。它成为你支出的主要部分通常的建议是减少你的工具列表,但这不是解决方案;这是权衡。你放弃了控制成本的能力,而这正是使用MCP构建的point。

2、Bifrost MCP Gateway是什么以及为什么它不同

Bifrost最初是一个开源的LLM网关,一个统一层,用于管理人工智能提供商、路由、密钥和跨技术栈的成本。当团队从单模型调用转向完整的代理工作流时,他们自然开始通过它运行MCP服务器。

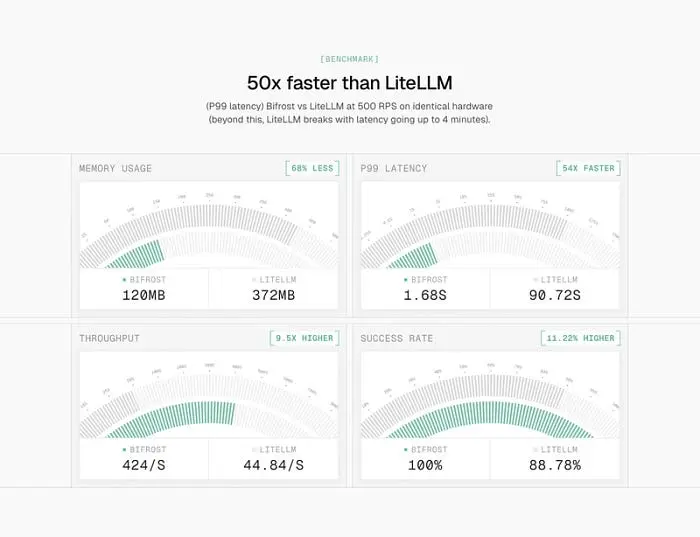

结果是Bifrost MCP Gateway,一个单一部署,同时处理LLM路由和MCP工具执行,内置访问控制、成本治理和完整审计追踪。它用Go编写,在Apache 2.0下开源,设计得像基础设施而不是开发者的便利包装。

如果你熟悉LiteLLM或Portkey等替代方案,Bifrost处于不同位置,为生产规模而构建而非原型便利。你可以在Bifrost alternatives page上看到详细分解,但主要区别是性能。Bifrost在5000请求每秒时只添加11微秒开销,而基于Python的替代方案则是数百毫秒。

它也是现有SDK的直接替代品。

切换看起来像这样:

import os

from anthropic import Anthropic

anthropic = Anthropic(

api_key=os.environ.get("ANTHROPIC_API_KEY"),

base_url="https://<bifrost_url>/anthropic",

)

更改一行。其他一切保持不变,正如我们导入Anthropic API密钥所示。

3、代码模式:Bifrost的修复

为了在不影响工具访问的情况下解决token膨胀问题,Bifrost构建了称为代码模式的东西。

这个想法并不完全是新的;Cloudflare用TypeScript运行时探索了类似的方法,Anthropic自己的工程团队写关于从150,000个代币的上下文丢弃到2,000个用于Google Drive到Salesforce工作流。Bifrost将其原生构建到网关中,有两个关键选择。Python而非JavaScript(因为LLM在显著更多的Python数据上训练),以及一个专用文档工具来进一步压缩上下文。

代码模式不是将每个工具定义注入上下文,而是将你的MCP服务器公开为轻量Python存根文件的虚拟文件系统。模型只读取它需要的内容,编写一个简短的编排脚本,然后Bifrost在沙箱Starlark解释器中执行它。完整工具列表永远不会触及上下文。

模型获得四个元工具来工作:

| 元工具 | 它的作用 |

|---|---|

| listToolFiles | 发现哪些服务器和工具可用 |

| readToolFile | 为特定服务器或工具加载Python函数签名 |

| getToolDocs | 在使用特定工具之前获取详细文档 |

| executeToolCode | 针对实时工具绑定运行编排脚本 |

当代码模式生成编排脚本时,多步骤电子商务工作流看起来像这样,而不是逐个调用工具:

customer = crm.lookup_customer(email="john@example.com")

orders = crm.get_order_history(customer_id=customer["id"], limit=5)

discount = billing.calculate_discount(customer_tier=customer["tier"], order_count=len(orders))

billing.apply_discount(customer_id=customer["id"], discount_pct=discount["pct"])

email.send_confirmation(to=customer["email"], discount_pct=discount["pct"])

Bifrost在沙箱Starlark环境中执行它,没有导入,没有文件I/O,没有网络访问,只有工具调用和基本类似Python的逻辑。模型永远不会看到中间结果;它只得到最终输出。完整工具列表永远不会触及上下文。

4、基准数据

Bifrost用代码模式开关进行了三轮受控基准测试,在轮次之间扩展工具数量,以查看 savings 如何随着MCP footprint增长而变化。

这里有两件事突出。首先,savings 不是线性的,它们随着你添加服务器而增长。经典MCP在每次请求上加载每个工具定义,所以连接更多服务器会以更快的速度使问题变得更糟。代码模式的成本由模型实际读取的内容控制,而不是存在多少工具。

其次,最重要的是,准确率没有下降。通过率在所有三轮保持在100%。你不是在为成本节省交易能力,你两者兼得。

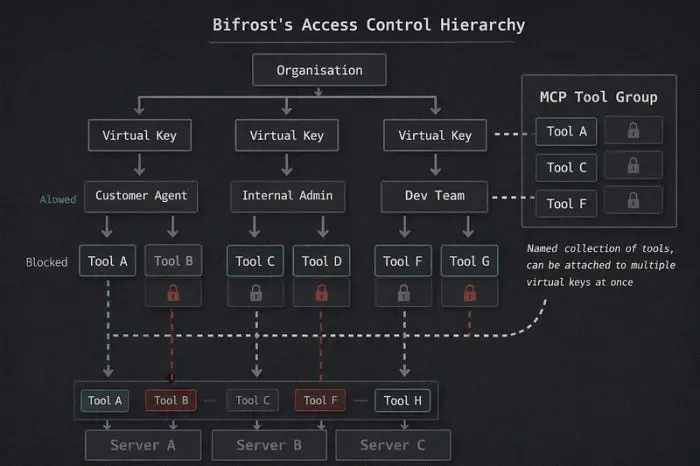

5、访问控制和治理

成本只是MCP规模上生产问题的一半。另一半是控制。当新工程师加入你的团队时,你不会给他们对公司运行的每个系统的无限制访问。但当你将人工智能代理连接到没有治理层的MCP服务器 fleet时,你实际上做了什么。

Bifrost MCP Gateway通过三种机制处理这个问题:

1. 虚拟密钥: 为你的MCP网关的每个消费者发布作用域凭据。每个密钥携带一组特定工具的调用权限,在工具级别作用域,而不仅仅是服务器级别。一个密钥可以被授予filesystem_read而不被授予同一MCP服务器的filesystem_write。面向客户的代理根本无法访问你的内部管理工具。

2. MCP工具组: 用于跨团队、客户和提供商规模化管理访问。工具组是一个命名的工具集合,来自一个或多个MCP服务器。将其附加到虚拟密钥、团队或用户的任意组合。Bifrost在请求时间解析允许的集合,无需数据库查询,一切都在内存中索引并跨集群节点自动同步。

3. 审计日志: 每个工具执行都记录有日志条目。对于每次调用,你获得工具名称、来自的服务器、传入的参数、返回的结果、延迟、触发它的虚拟密钥以及启动代理循环的父LLM请求。调出任何代理运行并准确追踪它调用了哪些工具,按什么顺序,以及返回了什么。

Bifrost还在工具级别跟踪成本。MCP成本不只是代币成本,如果你的工具调用付费外部API,每次调用都有价格。这些与LLM代币成本一起出现在日志中,让你完整了解每次代理运行的实际成本。

对于有合规要求的团队,日志管道设计用于SOC 2 Type II合规、GDPR、HIPAA和ISO 27001。内容日志可以按环境禁用,同时仍捕获工具名称、服务器、延迟和状态。

6、如何在几分钟内开始

Bifrost设计用于快速采用。如果你只是想快速启动网关,npx -y @maximhq/bifrost 在30秒内让你运行,你可以在Setting Up指南中遵循。

以下步骤通过仪表板完成完全治理设置,这是从零到完全治理的MCP网关的路径,启用了代码模式:

步骤1:添加MCP客户端导航到Bifrost仪表板的MCP部分。添加你的第一个MCP服务器,给它一个名称,选择连接类型(HTTP、SSE或STDIO),并输入端点或命令。Bifrost连接,发现其工具,并按配置的间隔开始同步。

步骤2:启用代码模式打开客户端设置并切换代码模式。没有模式更改,没有重新部署。代币使用立即下降。

步骤3:设置工具自动执行默认情况下,工具调用需要手动批准。打开自动执行设置并允许列出你想自主运行的工具。你可以在工具级别允许列出,filesystem_read可以自动执行,而filesystem_write保留在审批门后面。

步骤4:用虚拟密钥限制访问为每个消费者(用户、团队、客户集成)创建一个密钥。在MCP设置下,选择该密钥可以调用哪些工具。使用该密钥的任何请求只看到它被授予的工具;模型永远不会收到其范围之外的工具定义。

步骤5:将Claude Code连接到BifrostBifrost通过单个/mcp端点公开所有连接的MCP服务器。在Claude Code MCP设置中使用该URL添加Bifrost作为MCP服务器。Claude Code通过单个连接发现每个连接服务器的所有工具。在Bifrost中添加新的MCP服务器,它们自动出现在Claude Code中,无需客户端配置更改。

完整设置文档、性能基准和部署指南可在Bifrost resources hub获得。

7、结束语

大多数团队从一个MCP服务器和一个代理开始,它工作得很好。然后他们添加更多服务器、更多团队、面向客户的工作流,以及早期可以忽略的事情变得不可避免。谁可以调用什么,这实际上花了多少钱,以及什么东西破裂时发生了什么。

代码模式是对成本问题的惊人回答,在规模上92%的代币减少,没有准确率权衡。但治理层(虚拟密钥、工具组、审计日志、每工具成本跟踪)对于超越原型的团队同样重要。

Bifrost的LLM网关处理同一等式的模型侧,即提供商路由、回退、负载平衡 Rate Limiting,以及跨每个主要人工智能提供商的统一密钥管理。当两者都流经同一网关时,你获得每个代理运行的完整图景,模型代币和工具成本在一起,在单一访问控制模型下,在一个审计日志中。

如果你正在构建生产人工智能代理工作流,值得看看那个基础设施层实际上应该做什么。

原文链接: How Bifrost’s MCP Gateway Cuts AI Agent Token Costs by 92% Without Sacrificing Capability

汇智网翻译整理,转载请标明出处