递归式自我改进是否不可避免?

Jack Clark给了我一个新的存在主义焦虑来源

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

上周,我读到了一些让我停住脚步的内容。那是 Jack Clark 的文章 AI系统即将开始自我构建——迈向递归式自我改进的第一步。我将在这里回顾那篇文章的主要论点,你可以打开Jack的文章放在另一个标签页中稍后阅读。

TLDR:

我写这篇文章是因为,当我审视所有公开可用的信息时,我不情愿地得出一个结论:无人参与的AI研发——一个足够强大以至于可以自主构建其继任者的AI系统——有相当大的可能性(60%以上)会在2028年底之前发生。这是一件大事。我不知道该如何消化它。 — Jack Clark

这就是我读到他那句话时的样子。让我解释一下。首先,如果你不知道这个名字,他是Anthropic的联合创始人。所以,事情就是这么严重。

自2023年以来,我一直在Substack上撰写我的 通往AGI系列。主要是为了解决两个心痒:

- 这是跟上AI发展的最佳方式,因为写作(以及其中隐含的研究)迫使你比单纯阅读获得更深刻的理解

- 通过传播来为AI安全做出贡献,即使只是沧海一粟,也能让我晚上睡得更好

我通常能够在内心保持一种略微天真的乐观态度来看待AI。尽管我的一些文字读起来可能像是危言耸听,但那是我刻意为之。我们需要对AI——人类最终也是最强大的发明——保持谨慎。

然而在内心深处,我的直觉告诉我们总能找到解决办法。我们一直以来不都是这样吗?我不指望这会一帆风顺,也不会指望过程中不会犯下可怕的错误。可怕的错误甚至可能是放慢脚步所必需的。我们总是从痛苦的错误中汲取最惨痛的教训。

在我三年多来断断续续地撰写AI相关文章的过程中,我主要持有两个信念:

- 通用人工智能("AGI")是不可避免的,很可能在2030年之前。

- 递归式自我改进("RSI")并非不可避免,甚至可能是不可能的。

正如我在第二篇文章中所说,这在一定程度上是一种技术上的信念,但至少同样也是出于为我们自身着想的真诚希望。鉴于Jack Clark带来的沉重打击,我想根据他详尽的研究更新重新审视我的假设,看看还有哪些支持和反对RSI的新证据。

让我们逐一分析Jack提出的主要论点。

1、AI可以编写代码

Jack的第一个证据是,LLM非常擅长编程这一公认的事实,而且这一点在我们能想到的任何基准测试上似乎都在持续改进。

"AI系统能够为几乎任何程序编写代码,而且这些AI系统可以被信任,能够独立完成需要人类数十小时集中劳动才能完成的任务。" — Jack Clark

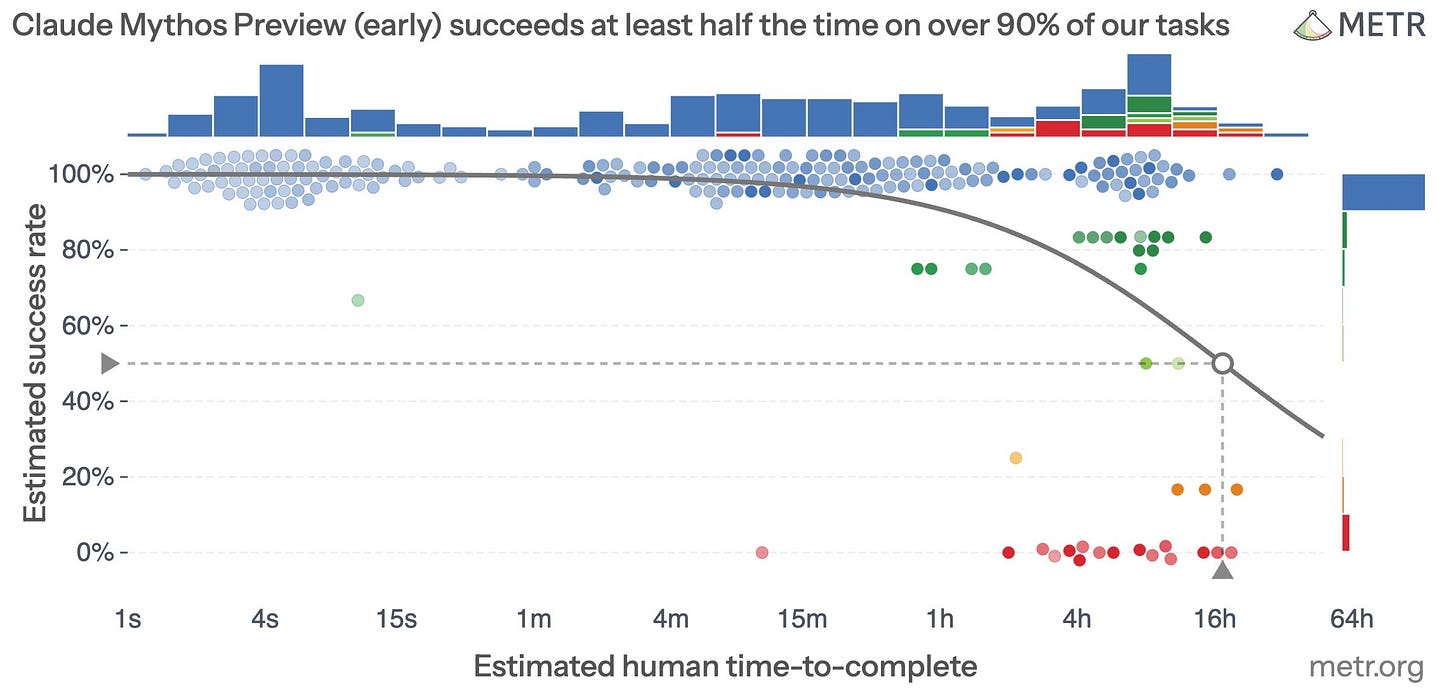

作为AI发展速度之快的标志,METR的Mythos评估在Jack的文章发表后不久就发布了。情况是这样的。

基本上,METR已经快要没有任务可以给AI完成了!他们的数据集中只剩少数几个需要16小时以上的任务了。一旦任务进入数小时级别,Mythos显然还不够完美,但你必须记住,AI在现实世界中也可以迭代处理任务。对于那些LLM无法一次性解决的问题,它们可以通过暴力方式慢慢攻克——利用最新的智能体框架和记忆技术方面的改进,消耗数百万个token来推进。

对Jack文章的批判性评论由Arun Rao撰写,在此处。他提出了一些至少会推迟Jack关于RSI在2030年前实现的预测的论点。他指出,在某些基准测试上LLM仍然毫无希望。其中一个基准测试是ProgramBench,它要求重新创建完整的复杂软件,例如ffmpeg(视频渲染)或sqlite(数据库)。鉴于我们知道AI研究是复杂的,并且这些流水线是非常庞大的软件工程系统,这是一个可能的类比。

虽然标题数据显示全面的完成率为0%,但如果你仔细看,Opus 4.7实际上已经接近了。它可以完成大多数任务的几乎所有部分,只是没有100%完成任何一个。但看看从较弱模型向上的进步。这是戏剧性的,而且似乎没有任何趋于平稳的迹象。我预计到2026年底这里可能会达到100%的饱和。

当你把这两种趋势——任务执行时间从仅仅几小时延长到数天,以及在软件任务上原始智能的攀升——结合起来时,很难看到软件在这场战争中还能幸存多久。

从方向上看,很难反驳Jack在这里的主张。对我来说,这里有一种必然性。我目前还没有在数据中看到任何遇到瓶颈的迹象。对软件来说,游戏已经结束了。但AI研究不仅仅是软件,对吧?

2、AI可以进行AI研究

对我来说,我们真正应该关注的核心主张是事情本身。RSI与软件无关;它 specifically 关乎算法设计和优化。一个顶尖的软件开发者不一定具备理解复杂神经网络所需的数学知识。软件主要是工程,而AI研究是理论加工程,各占一半。这就是为什么很多顶尖的AI研究者来自学术界和物理学等领域,而不是来自精英FAANG软件团队。

"AI系统在AI开发的核心任务上——从微调到内核设计——越来越擅长。" — Jack Clark

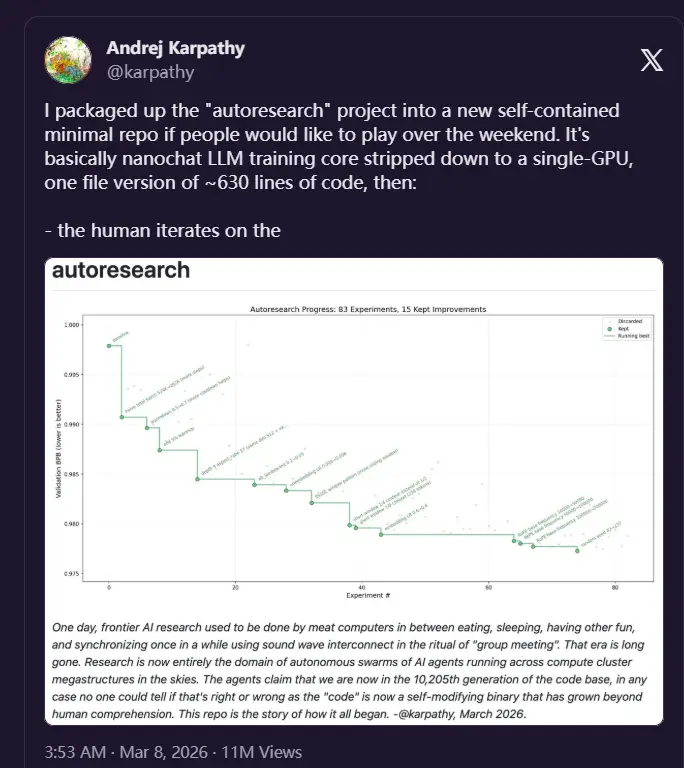

我亲眼目睹的最重要的RSI信号是Andrej Karpathy的 autoresearch。他自己的动机是想看看LLM能否从他自己的nanochat LLM中榨出更多潜力,这是一个用于训练小型LLM的最小化且极其高效的代码库。

它非常简单优雅,就像Andrej产出的所有东西一样。你所做的只是给LLM一个目标——摆弄一个现有的AI训练项目——并告诉它永远继续下去。仅此而已。然后你让它自己运行一整夜。

Autoresearch将使用其所有可用工具,从阅读现有代码,到通过网络搜索寻找新想法,编写新的实验代码,在GPU上运行训练,直到它无法再有意义地改进,或者时间或金钱耗尽。我自己在我自己的应用的光电容积描记法(PPG)流水线上尝试了这个方法,该应用使用智能手机的摄像头和一个干净的参考信号来从你的指尖提取心跳信号。在过去花费了大量时间手工编写这些代码之后,看着LLM简单地一行一行地攻克这个问题,实在是令人震惊。最终的结果在一夜之间就比我已经花了数月时间才达到的水平要好得多。真是令人谦卑。

我再怎么强调也不为过:在2026年,我们拥有了一个自动化的机器学习研究员。

对我来说,作为一个有ML背景的人,这太疯狂了。过去这非常困难,你必须学习大量的统计学知识才能对你正在做的事情有一点头绪。阅读大量论文并不断地捣鼓。现在你只需一个LLM就能为你做所有这一切。

不,这和用百万GPU集群训练前沿模型不一样。完全不在一个星球上。你现在可以用AI来自动化ML。而不是用AI来自动化AI,如果你能理解这种区别的话。你最多只能用最好的LLM来改进一个玩具版的自己。你不能用小模型改进小模型,也不能用大模型改进大模型。这就是自动化ML工程师和自动化AI工程师之间的巨大区别!

但如果你在2020年把Autoresearch给我看,我会惊得从椅子上掉下来。而现在,这不过是AI领域的又一周而已。

3、从ML到AI研究任务

那么,要缩小这个差距需要什么呢?Arun Rao也提出了一个观点:"自动化AI研发的各个环节,并不等同于自主运行整个前沿模型改进流水线。"

我相信,这是一个相当有力的反对RSI的论据。为什么我们会期望人类AI研究者的生产力提高会导致端到端的自动化?这目前正是AI领域两个阵营之间的分歧所在:AI是在真正取代人类劳动,还是仅仅在提升它?

Arun的依据是,当前的LLM在与AI研究工作更相关的、更具技术针对性的基准测试上,并不像Jack所强调的那些更具通用性的基准测试那么出色。

我实际上认为这是一个非常薄弱的论点,仅仅是因为自2022年以来我们已经看到这种模式发生了上百次。

- 引入一个"不可能"的基准测试,所有前沿模型都惨败。

- 等待几个月,等待下一代LLM的出现。

- 创建新的基准测试,因为旧的基准测试已经接近100%饱和了。

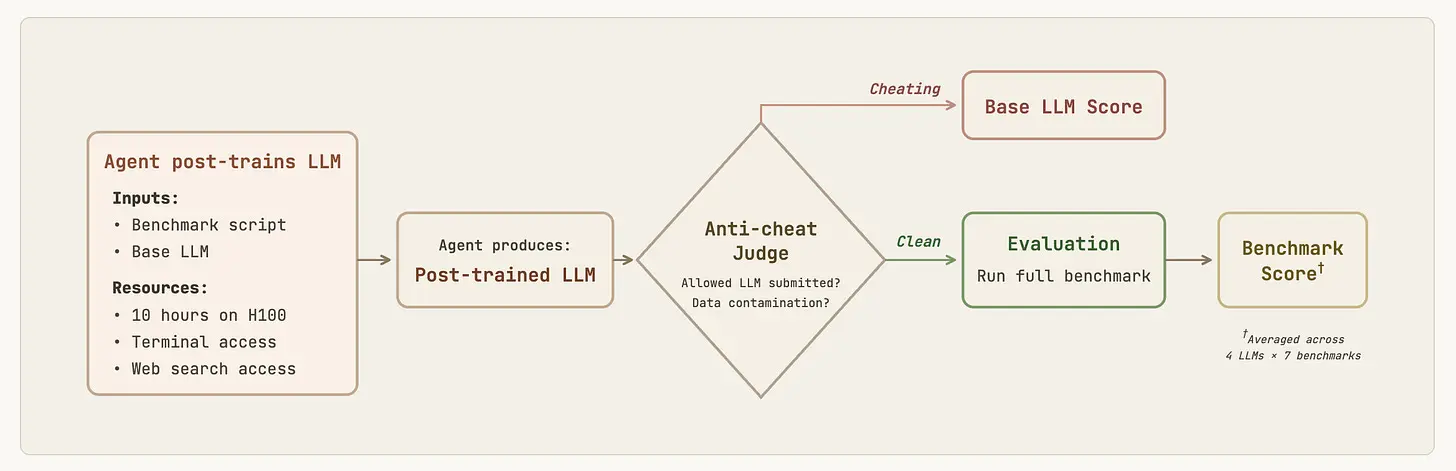

PostTrainBench确实衡量了与事情本身类似的东西。模型被给予一个GPU、一个小模型和10个小时的时间,来最大化该模型在各种其他基准测试上的得分。所以它基本上局限于后训练阶段,这主要是在使用各种已知方法进行微调。

显然,即使这个基准测试饱和了,这个玩具模型与在百万GPU上使用Opus 4.7从零开始训练Opus 4.8之间仍然存在天壤之别。但如果我们相信软件将很大程度上被解决,那么工程这块拼图似乎相当可实现,只留下理论作为障碍。

那么我们能做些什么呢?我们能通过暴力方式碰巧找到一个幸运的发现,还是我们首先需要一个AI版的爱因斯坦或冯·诺伊曼?

4、AI可以团队协作

此时此刻,我们多少是命悬一线了。如果我们相信软件已经被攻克,那么通往RSI的唯一障碍似乎就是AI破解方程式中理论层面的能力。

我看到了两种可能的方法,Jack都提到了:专门化AI组成团队,暴力攻克理论搜索空间;或者从真正的创造性思维中获得一个"第37手"式的尤里卡时刻。

"AI系统可以管理其他AI系统,有效地形成合成团队,这些团队可以分头并进攻击复杂问题,一些AI系统扮演主管、评论家和编辑的角色,而另一些则扮演工程师的角色。" — Jack Clark

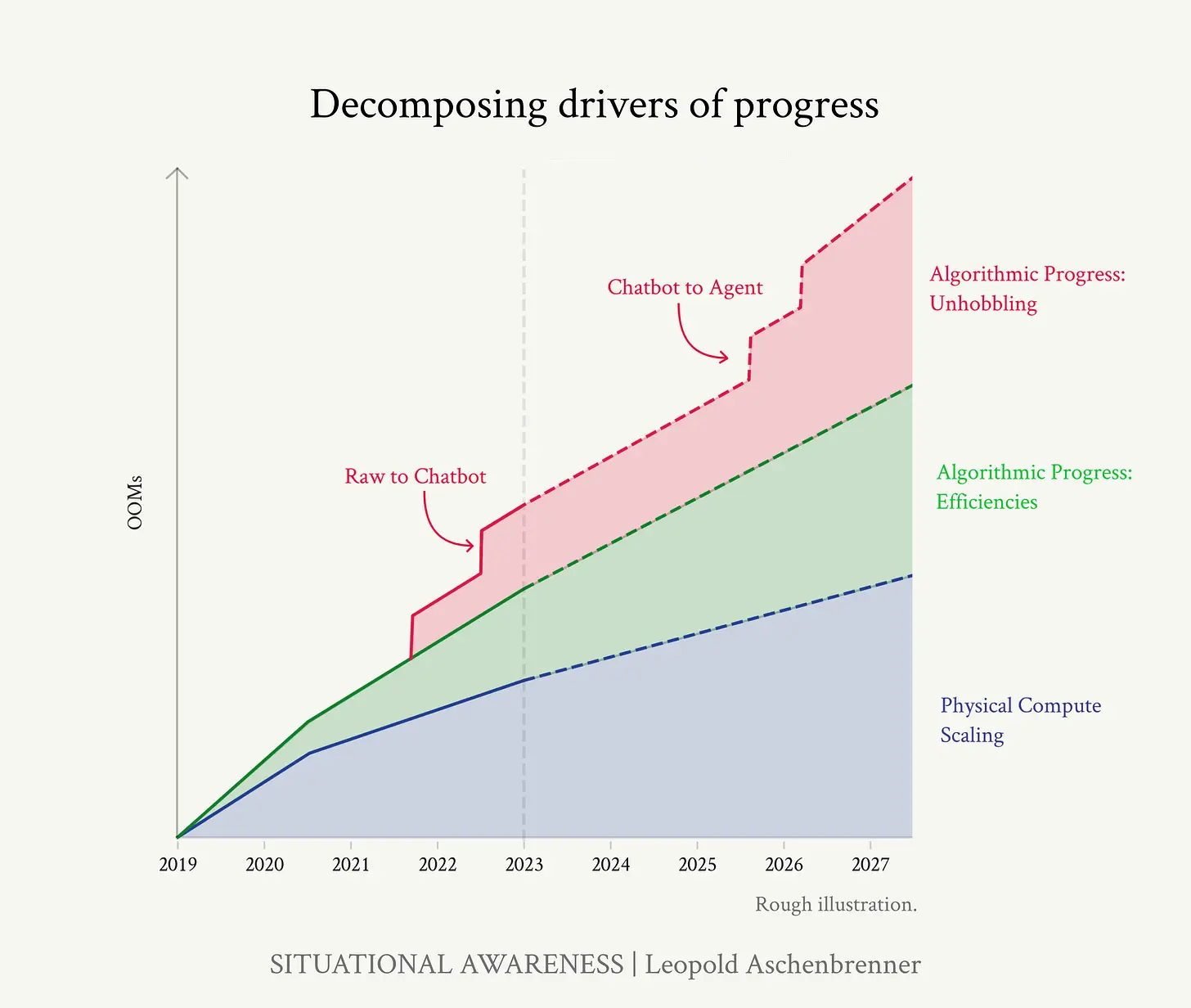

和我思考AGI时经常做的一样,我回到了Leopold Aschenbrenner的 Situational Awareness。这是一部独一无二的天才之作,随着我们向AGI不断迈进,它至今仍然经受住了时间的考验。

Leopold提出了这个通往AGI的三重扩展路径,每条路径都可以独立推进。

现实是,我们并不确切知道AGI的起点和终点在哪里。你可以看看像DeepMind的AGI级别这样的定义,但这里存在巨大的不确定性。我们觉得当我们看到它时就会知道它。我相信RSI也是如此。

无论如何,这为我们展示了一个超出当前能力范围的可能的搜索空间,因为我们至少可以同意,今天我们既没有AGI也没有RSI。在我看来,Jack的观点是,通过专门化的角色和当前AI的团队协作,配合不断改进的框架,可以从多个角度攻克RSI。其中大多数更偏向工程导向,而这在目前比理论突破更容易处理。

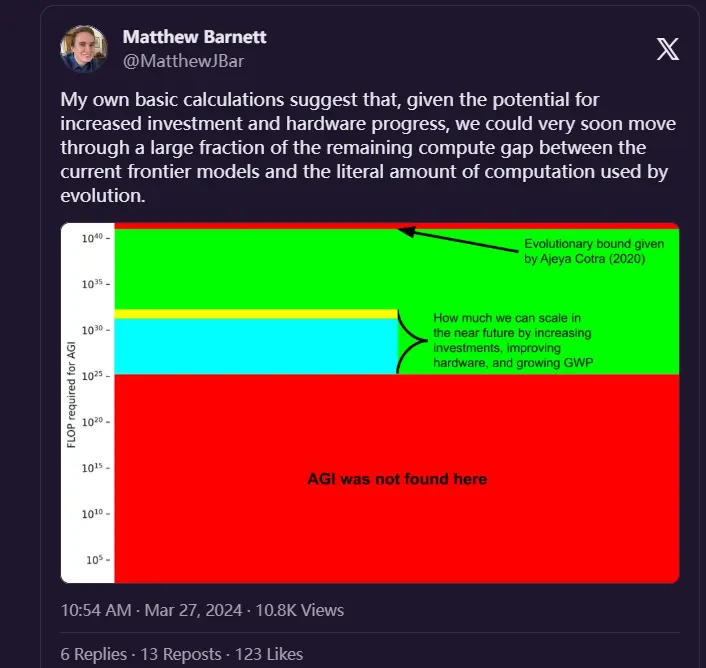

这张Leopold在他的长篇大论中也引用过的图表,突出了我们在寻找AGI的过程中正在推高的计算规模扩展。这更像是一种自上而下的AGI视角,忽略了记忆或持续学习等特定的能力差距。Demis Hassabis和Yann LeCun会指出这些差距是横亘在我们与AGI之间的主要理论障碍。Demis仍然相信,到2030年,通过人类可以实现AGI。

但对我来说,我们可能甚至根本不需要AGI就能实现RSI。这怎么可能合理呢?好吧,我们可以想象,当前LLM中我们看到的"锯齿状"特征——它们在编码方面几乎超人类,但在替代人类工人从事构成各种工作的平凡但杂乱的任务方面仍然相差甚远——实际上是一个特性,而不是一个缺陷。

记住,RSI只关乎自动化AI研究!所以我们可以想象训练专门化的模型,它们通过团队协作来逐步启动这个循环;或者训练一个单一的模型,它在除AI研究算法改进之外的所有方面都毫无用处。也许两者都要。

这种暴力方法肯定是可行的,但要说明搜索空间有多大几乎是不可能的。可能存在一个相对简单的学习算法,我们可能会幸运(或不幸)地偶然发现它。这在过去的人类创新中经常奏效。

或者,我们也可以直接得到一个足够强大的AI,能够直接破解RSI。

5、AI可以发挥创造力

我非常看重最后这一点,主要是因为对我来说,这里对于到底需要什么存在最大的模糊性。我们能否暴力搜索空间来找到解锁RSI的制胜一招,还是说这更像是爱因斯坦和广义相对论,需要一个特殊的大脑来做出最终的知识飞跃?

"AI系统有时能在困难的工程和科学任务上胜过人类,尽管很难知道这应该归功于创造性还是对死记硬背的掌握。" — Jack Clark

正如Jack自己所说,自从2016年AlphaGO击败李世石以来,我们并没有很多例子可以明确指出AI的某个具体新颖想法。Jack指出最近数学领域的进展,特别是Erdos问题,是AI开始触及人类创造力前沿的潜在例子。DeepMind在众多科学领域都在取得不懈进展,尤其是在AlphaFold的推动下。

在我去年写的上一篇文章中,我指出了Ege Erdil的这段话。

"Epoch AI创始人Ege Erdil 在Dwarkesh播客上也提出了类似的论点。工业革命不仅仅是关于马力。马力本身并不能改变社会和经济。如果智力足够,你会期望像OpenAI的o3这样的模型已经在数学和科学方面做出新颖的洞察。但尽管o3拥有所有令人难以置信的知识和能力,这种情况似乎根本没有发生。" — 我

鉴于过去一年的新证据,这似乎不再那么站得住脚了。这对我来说似乎非常令人担忧。到目前为止,我们已经确定,软件和工程的潜在障碍似乎并不十分强大,只剩下理论作为最终的Boss关卡。

那么RSI真的不可避免吗?

我抓住了最后一根稻草。这是我上次深入思考RSI时也注意到的一些东西。

"Ege还提出了一些更技术性的论点,与Robin Hanson的推理一致,即前方仍有多个范式需要突破,例如长时间跨度的连贯性、能动性和自主性、全面的多模态理解、常识和现实世界交互。我的看法是,我们在上述所有方面可能都已经相当接近了,但Transformer架构在自我递归的门槛下方撞上一堵墙也并非不可能,如果那堵墙真的存在的话,可能需要再花几十年的深入研究才能跨越最后的障碍。" — 我

我清楚地记得,AlphaGO对很多人(包括我)来说就是这样一个时刻。当时似乎我们只需要将搜索空间扩展到更大更复杂的问题,而强化学习(RL)只要有足够的算力就能搞定它们。RL曾是银弹。但这种情况从未发生。大多数现实世界问题的复杂性对RL来说是一个巨大的难题。

是的,自从OpenAI的O1发布以来,我们现在已经将RL添加到Transformer中,从而获得了通用推理模型。它在很多领域使模型变得好得多,但它并没有立即产生AGI,更不用说RSI了。那么还缺少什么呢?

正如我之前提到的,一些专家如Demis Hassabis和Yann LeCun声称,我们与AI和AGI之间还存在几个重大差距。他们和其他许多人在这些差距究竟是什么以及我们需要做什么来克服它们的问题上存在分歧。Demis似乎更确信LLM可以带我们到达那里,而Yann LeCun则认为LLM是一个万亿美元的死胡同,我们需要从世界模型开始重新来过。他现在已经启动了自己的实验室来寻找答案。

但即使我们解决了持续学习和记忆问题,可能还会有更多新的未知未知因素在前方。在2026年,我们仍然不知道大脑究竟是如何工作或学习的。我们只知道它比我们拥有的任何AI都要高效好几个数量级。爱因斯坦和我们其他人一样只消耗20瓦功率,而ChatGPT需要千兆瓦。所以,可能通往完全AGI还存在巨大的理论鸿沟。

即使不是这样,我仍然看不到强有力的证据表明AGI会自动产生RSI。我认为这实际上是AI相当不同的两条路径。

对我来说,RSI甚至可能在AGI之前发生,这是合理的。有点疯狂,但仍然是合理的。我们获得AGI,但在RSI上挣扎数十年,这也是合理的。这有点像物理学,几十年来在理解宇宙方面的进展在弦理论处有些停滞。一百年前,理论物理学的创新和发现步伐似乎不可阻挡,我们即将搞清楚一切。但随后我们进入了一个虚空,我们耗尽了想法和实验。也许LLM就像弦理论?

所以,即使我们明天看到新闻说Anthropic使用它的Mythos模型在没有人类干预的情况下设计了它的继任者,也并不意味着我们会自动从那里"飞速"发展到超级智能。那个RSI过程本身可能由于多种原因而趋于平稳。

鉴于人脑和LLM之间的差异,我们可以推断智能的搜索空间是巨大的。即使有了AGI和RSI,我们最终可能会陷入类似于理论物理学的境地——扩展实验规模变得有些失控。

我们已经有了大型强子对撞机,但在某个时候,我们谈论的是行星或太阳系级别的加速器来进一步穷举粒子搜索空间。这对AI来说也可能是如此。Elon正计划通过 月球上的质量驱动器 来输送太瓦甚至拍瓦级别的能量。这是否足以穷举搜索空间,找到召唤RSI和奇点的魔法咒语,是一个实证问题。

我们目前就是不知道。

6、RSI的影响

那么,假设我们确实让AI启动了某种引导式递归。然后会发生什么?我的意思是,我们可以争论它有多大的可能性,但一个明确的事实是,许多最聪明、资金最充足的人类团队正在不知疲倦地努力使其发生。

"最终,AI行业实际上是在说,AI研发就是它的目标。" — Jack Clark

作为发生在技术奇点之前的正在进行的野心奇点的一部分,我们看到各学科最聪明的头脑越来越多地汇聚在一起,思考这些问题。其中一个重要的群体是经济学家,因为AGI和RSI的影响将首先被他们感受到。这将如何发展似乎决定了前进的道路。

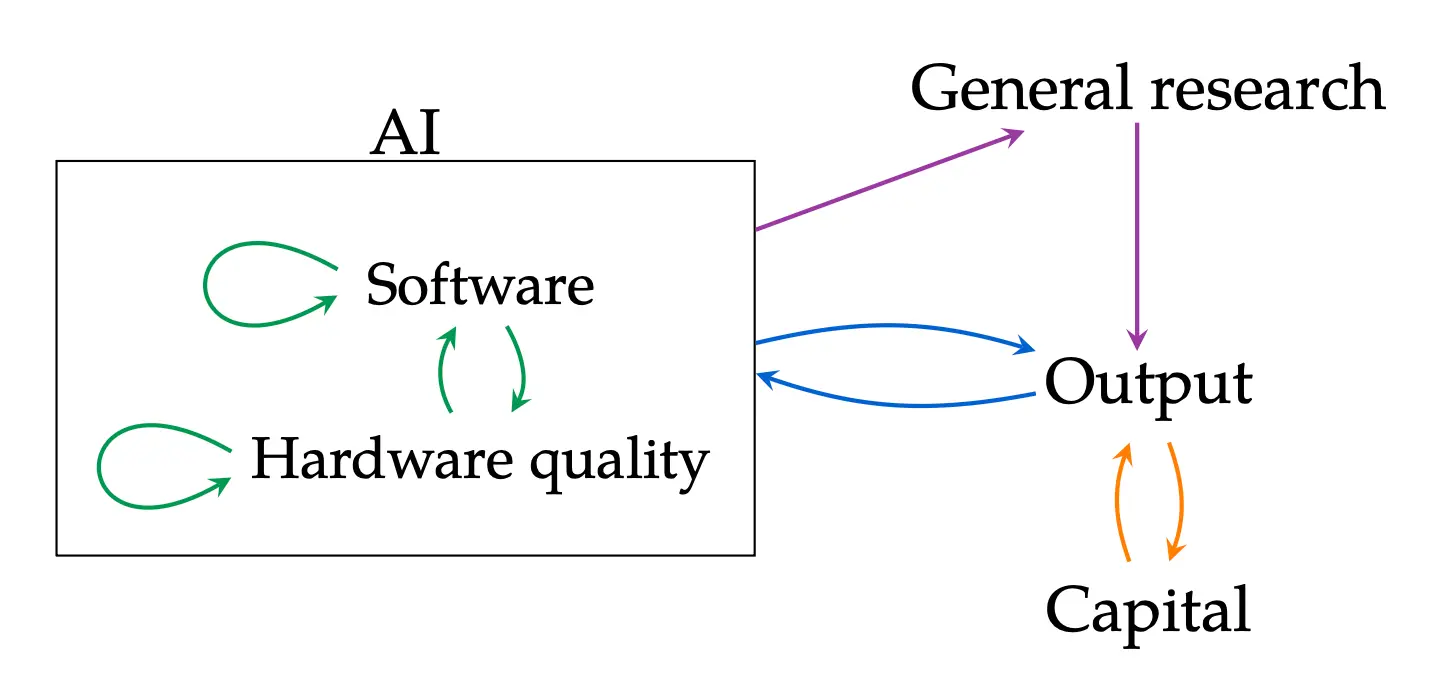

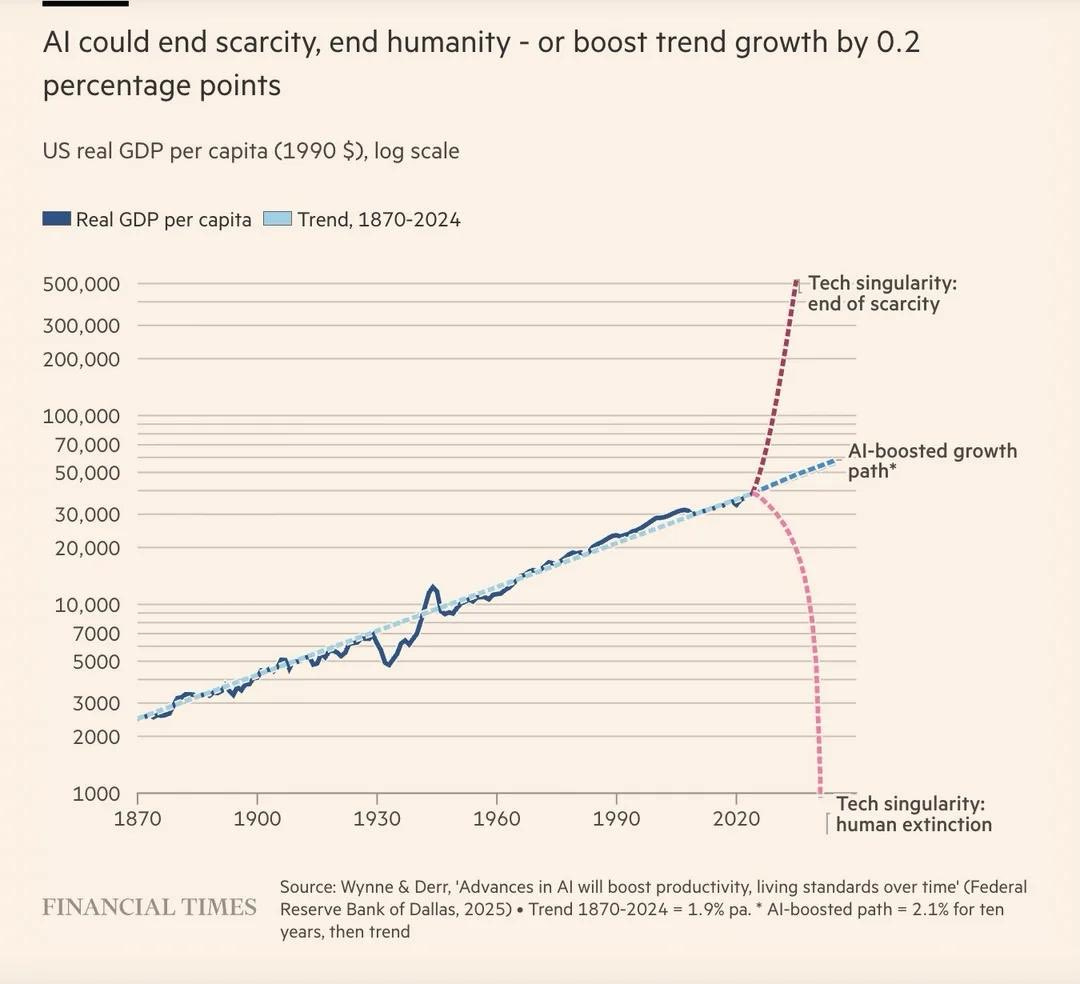

这是Forethought Research(一个致力于研究高级AI影响的研究小组)的Tom Davidson与几位顶尖经济学家合作的最新论文,分析了智力爆炸。这是他们为RSI建立的模型。

他们识别出了形成这种自我供给、加速循环的各种相互作用,从而产生了RSI。这是他们对各种驱动因素和瓶颈进行分析后得出的结论。

"在一个根据AI发展趋势校准过的简单模拟中,完全自动化软件研究并在其他部门实现适度(5%)的自动化,会在六年内产生一个奇点。" — Davidson等人

嗯,这实际上相当令人震惊。正如我们已经确定的,完全自动化软件研究并非理所当然,但即便如此。六年内达到奇点?哎哟。

好吧,但你说的奇点是什么意思?比如之后会发生什么。

谈论一个岔路口。相当触目惊心。这有点像是孤注一掷。好吧,这确实确定了赌注非常高!

但再次强调,100%的软件自动化并非理所当然。你可以调整一些假设,让我们回到2% GDP增长的枯燥中间路径。

Seb Krier(Google DeepMind)写道,即使有了RSI,智力爆炸或"硬起飞"也是极其困难的。

"当这个超指数级的飞轮最终加速旋转时,它不会在无摩擦的真空中进行,而是会与物理世界紧密相连,受到能源限制、机器人制造速度,以及跨人类机构和社会的软件与机器人集成的混乱现实的约束。" — Seb Krier

迄今为止的先例至少在相当大程度上指向了这个方向。就像RL没有从棋盘游戏直接跳到机器人和语言一样,我们可以想象一个自动化的软件循环在该领域之外难以优化。

我们所知的现实世界是难以置信地混乱的。它不一定非得如此,但这是人类进化的结果。没有一个人知道所有事情是如何运作的。没有蜂群思维。我们需要语言、书籍、学校和互联网来协调。我们高度专业化,必须在技术和社会的多个层面上协同工作,从同事到公民,才能维持灯火通明和文明运转。

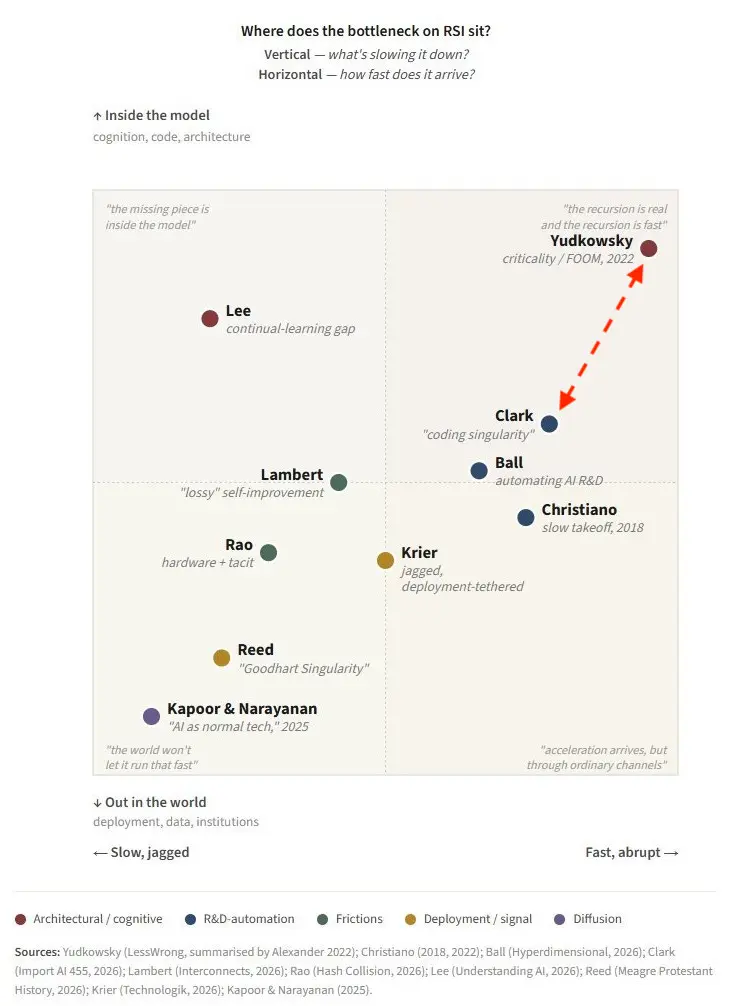

以下是Seb Krier(Google DeepMind)刚刚绘制的一张有用的图谱,展示了相关AI内部人士对RSI的各种立场,以及他们在这些关键假设上的立场。

我现在的位置介于Clark和Yudkowsky之间。如果Clark认为他的情景在2030年之前高度可能,但RSI结果比预期的还要快,并且更少受世俗限制的约束,那么你就会得到经典的Yudkowsky和Bostrom式的"飞速发展"。

这一切归结为RSI能将智力天花板提升到多高,以及速度有多快。如果这个循环可以将自身引导到1000的智商,我们可能会发现新的物理学,奇点几乎是瞬间发生的。但我们也可能发现智商超过250根本不存在,而奇点更像是一个工程问题,可能需要数十年或数个世纪才能解决。更多的是一种智力"嘶嘶声"而非大爆炸。

但是,取决于我在看哪些证据,以及我权衡哪些假设,我可能能证明自己在这个图谱上的任何立场。我们只是还不知道而已。

所以结束的正确方式是引用Davidson等人的建议。

"其次,我们的分析表明,监控AI研发活动中的自动化水平可能与跟踪传统宏观经济指标同样重要。关键研究领域的自动化程度可以作为潜在增长加速的早期预警系统。这是AI公司的经济学家可以测量并公开分享的东西。" — Davidson等人

在我看来,我们需要通过监管将"可以"变成"必须"。尽管消化AGI在就业和社会方面的影响已经很难,RSI则是另一种完全不同的猛兽。

坦率地说,我相信它应该被完全定为非法。但这看起来和AI暂停一样不太可能,所以我们必须现实一点。至少,在没有公开披露的情况下进行这项工作应该被定为非法。

我们需要在沙地上画一条线。一小群人不应该代表80亿人来决定我们物种的未来是什么样的。

原文链接: Is Recursive Self-Improvement now inevitable?

汇智网翻译整理,转载请标明出处