模型崩溃

当AI改变我们的行为和制度时,风险不仅仅是理论上的

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

大型语言模型的惊人成功归功于可用训练数据的质量——书籍、报纸、在线论坛、维基百科,还有开源软件项目的代码库。所有在网上被分享和讨论的内容都进入了这些模型。

尽管这些模型背后的算法极其巧妙,但如果没有这些数据,它们根本上无法产生智能行为,而它们产生的行为也取决于它们被训练的数据(因此这些模型倾向于复制刻板印象——比如外科医生往往是男性——因为这些在他们的训练数据中有所体现)。

生成式AI模型从定义上说产生新的输出。所以一旦你有了这些模型之一,你就可以产生无限多的训练数据。这能让你引导自己走向超级智能吗?

恰恰相反。

如果你在一个复杂的模型上训练它自己的输出,你会得到一种被称为模型崩溃的现象——在连续的迭代中,模型越来越聚焦于最常见或最典型的模式。性能指标最初甚至可能显示改善,但模型逐渐失去了表示边缘情况和非典型情况的能力。最终模型性能崩溃,因为它对所有输入产生相似且不适当的输出。

来自经典论文(Shumailov等人,2024)的一个例子。一个语言模型(在人类生成的数据上训练)对一个关于教堂的提示做出回应:

复兴建筑,如伦敦的圣约翰大教堂。垂直复兴建筑最早的现存例子可以在18世纪的格恩西圣母教堂找到,其历史可以追溯到19世纪末。有两种类型的垂直教堂[输出在达到限制后截断]

在使用模型生成数据并将其添加到后续几代的训练数据中九个世代之后,对相同提示的典型输出是:

建筑。此外,这里还是世界上一些最大的黑尾长耳大尾兔、白尾长耳大尾兔、蓝尾长耳大尾兔、红尾长耳大尾兔、黄尾长耳大尾兔种群的家园。

重复、无意义、疯狂地聚焦于训练数据的一个方面,以及一个相对于输入提示来说不适当的回应。

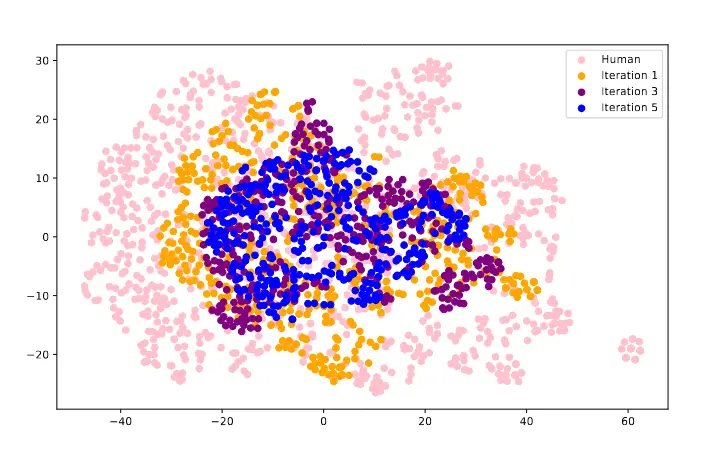

Guo等人(2024)对背后的机制做了很好的说明。与Shumailov等人,2024类似,他们在模型自己的输出上训练模型,然后将模型如何表示输入的空间可视化——这是模型语义空间中可能词语远近关系的映射。就像"猫"和"狗"应该在语义空间中接近,而"猫"和"宇航员"应该不那么接近一样,这展示了概念世界如何被成功的模型世代所表示。

随着时间的推移,模型"思考"输入的方式变得狭窄,降低了做出区分的能力——将所有输入折叠起来,使它们看起来都更加相似。这就是性能退化的原因。好的模型会根据你问的内容提供不同的输出。有时输入的细微变化可以产生输出的巨大变化。当模型失去对这种差异的敏感性时,它们就不再有任何用途了。

模型崩溃是许多科学领域中一种更普遍现象的AI实例:当测量工具和被测量的系统纠缠在一起时。在社会科学中,这被称为"卢卡斯批判"——当经济政策发生变化时,基于旧数据的经济模型预测就会崩溃。在医学中,当治疗方法改变疾病的进程时,它就会发生。在整个社会中,当一种技术既改变行为又是对行为的反应时,它就会发生。

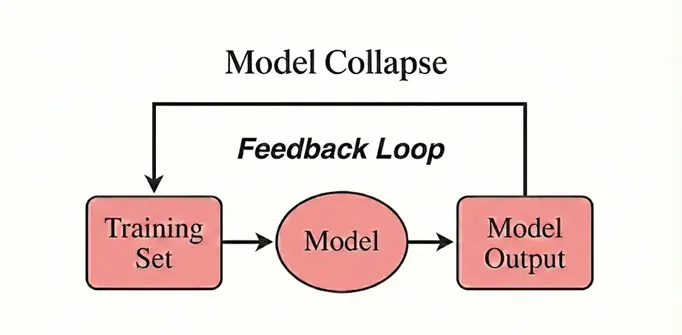

AI不只是在观察世界——它开始改变世界。而随着越来越多的人类活动通过AI模型运行,我们正在创建一个反馈循环,在这个循环中,模型不仅相互训练,而且还训练我们——以及我们创建的系统。

1、当制度从AI中学习

但模型崩溃不仅发生在模型上。它也发生在制度上。当人类机构开始依赖AI输出并将AI行为纳入其决策时,他们创造了自己版本的模型崩溃。

考虑评估。当大学使用AI评分工具时,学生就会学习如何为AI写作。当平台使用AI审核内容时,创作者就会学习哪些内容可以通过审核——这往往会导致内容的同质化。当招聘人员使用AI筛选简历时,求职者就会优化他们的简历以适应算法而不是适应工作。

在每一个案例中,测量工具都会改变被测量的系统。预测变成了自证预言。分类变成了指令。

2、脆弱的循环

AI系统现在在许多现实世界的循环中运行:

- 内容推荐:AI推荐内容 → 用户消费该内容 → 更多类似内容被制作出来 → AI学会更加推荐它

- 自动化新闻:AI撰写文章 → 人类阅读 → 人类行为被捕获为训练数据 → 下一代的AI从中学习

- 金融交易:AI进行交易 → 市场做出反应 → 市场数据反馈到AI模型中 → 策略同质化

- 医疗诊断:AI辅助诊断 → 临床医生学习和适应 → 临床实践发生变化 → AI在新的实践模式上训练

在每一个循环中,都有模型崩溃的潜力——不是AI模型崩溃,而是人类机构与AI系统耦合的系统崩溃。

3、我们如何思考这一点

模型崩溃是对在自身输出上训练的危险的警告。但它也是关于一个更深刻的原则:反馈循环可以破坏多样性、降低适应性并侵蚀质量。

当AI大规模部署时,它不仅仅是一个工具。它是一个行为者。它改变它所触及的系统。如果我们不注意到这一点,我们就会建立脆弱的系统——这些系统在看似良好的初始条件下运行,但逐渐失去它们所需的多样性、适应性和质量。

防止模型崩溃不仅仅是技术上的挑战。它还涉及保持AI系统中的人类多样性——以及人类机构中的AI多样性。

原文链接: Model collapse

汇智网翻译整理,转载请标明出处