AITune:推理后端比选工具包

忘记手动调优的马拉松吧。AITune 检查您的模型,对每个可行的后端进行基准测试并选出获胜者。所有这些都是通过一个单一的 Python API 完成。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

每个尝试将 PyTorch 模型投入生产的 ML 工程师都知道这个流程:与 TensorRT 的试错,凌晨 2 点调试 ONNX 导出失败,与 torch.compile 标志搏斗,最终不确定一个基准上的 40% 加速在部署时是否能保持。NVIDIA 决定结束这个循环。

2026 年 4 月 10 日,NVIDIA 正式宣布 AITune 一个位于 ai-dynamo GitHub 组织下的开源推理工具包——自动化 PyTorch 模型的整个后端选择和优化管道。这是该工具包的首次公开发布,它已经引起了 ML 工程社区的关注。

1、AITune 正在解决的问题

PyTorch 是深度学习的事实训练框架但让训练好的模型在生产中快速运行是一门完全不同的学科。 开发者面临着日益碎片化的后端格局:

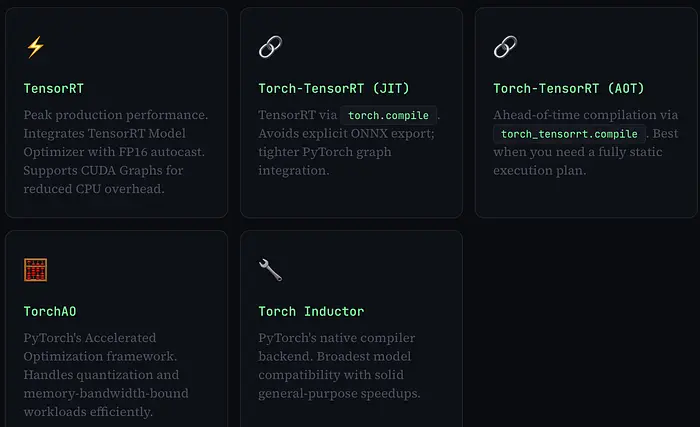

TensorRT 在 NVIDIA 硬件上提供峰值性能,但需要可能在大纲架构上静默失败的 ONNX 导出。Torch-TensorRT 通过 torch.compile 与 PyTorch 的图更紧密集成,避开了一些 ONNX 陷阱。TorchAO(加速优化)提供量化和低级内核优化。Torch Inductor,PyTorch 的原生编译器后端,广泛使用但并不总是在原始吞吐量上胜出。

"正确"的答案取决于你的模型架构、GPU 代际、精度要求和工作负载模式。而找到这个答案今天意味着从头构建自己的基准测试工具——一个经常被跳过的时间陷阱,留下了显著的性能。

"AITune 首先依赖您的软件版本与您的环境合作,并为您选择表现最佳的后端,以配合您的软件和硬件设置,引导您使用支持的技术。"

这是 AITune 的核心承诺:将它指向任何 nn.Module,给它一个数据集,它处理其余的分析、正确性检查和获胜配置的序列化。

2、工具包内有什么

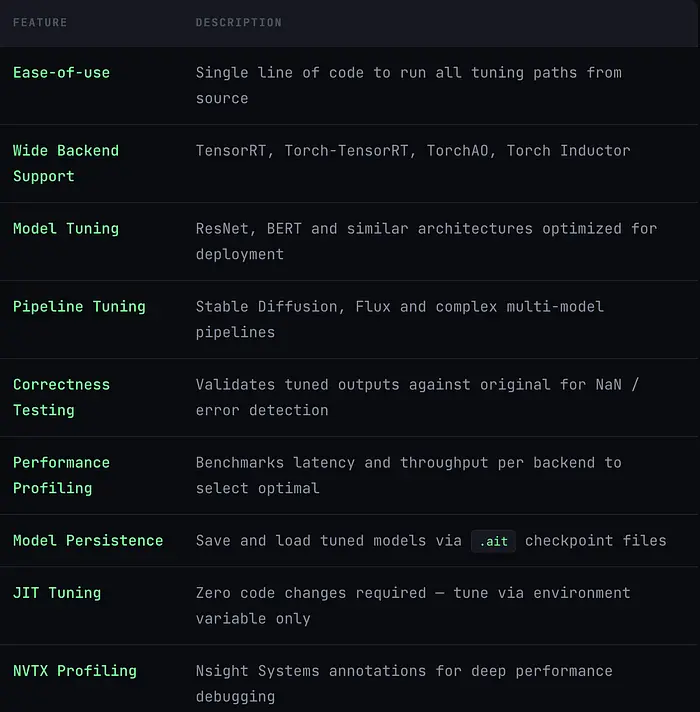

AITune 在 nn.Module 级别运行它不需要您重塑模型架构或采用新的训练范式。工具包的特性集对于 v0.3 发布很广泛:

两种调优模式:AOT vs JIT

AITune 附带两种根本不同的工作流程,让您在最大控制和零摩擦之间选择。

2.1 提前编译(AOT)调优

AOT 是高保真路径。您提供模型和数据加载器,使用 ait.inspect() 分析模型架构并识别可调优模块,用 ait.wrap() 包装选定的模块,然后调用 ait.tune()。生成的优化模型可以保存为可移植的 .ait 检查点以用于生产部署。

import aitune.torch as ait

import torch

from diffusers import DiffusionPipeline

# 像往常一样加载您的管道

pipe = DiffusionPipeline.from_pretrained(

"stable-diffusion-v1-5/stable-diffusion-v1-5",

torch_dtype=torch.float16

)

pipe.to("cuda")

input_data = [{"prompt": "A mountain lake at dawn"}]

# 检查:检测模块和调优机会

modules_info = ait.inspect(pipe, input_data)

modules_info.describe()

# 包装选定的模块并调优

modules = modules_info.get_modules()

pipe = ait.wrap(pipe, modules)

ait.tune(pipe, input_data)

# 保存获胜的后端配置

ait.save(pipe, "tuned_pipe.ait")

2.2 即时(JIT)调优

JIT 模式适用于无法修改代码的情况或者当您只想零摩擦尝试优化时。在脚本顶部添加单个导入(或设置环境变量),AITune 拦截模型执行,动态分析候选后端,并透明地替换最快的。

# 这一个导入就是所需要的

import aitune.torch.jit.enable

# 您 rest 的代码完全不变

import torch

from diffusers import DiffusionPipeline

pipe = DiffusionPipeline.from_pretrained("...", torch_dtype=torch.float16)

pipe.to("cuda")

# 第一次调用:AITune 检测层次结构并调优

pipe("A beautiful landscape with mountains and a lake")

# 第二次调用:透明使用调优后的模型

pipe("A beautiful landscape with mountains and a lake")

JIT 替代方案——完全无需更改代码

如果即使添加导入都太多,在运行现有脚本之前设置export AUTOWRAPT_BOOTSTRAP=aitune_enable_jit_tuning。AITune 自动引导,零源代码修改。

2.3 支持的后端

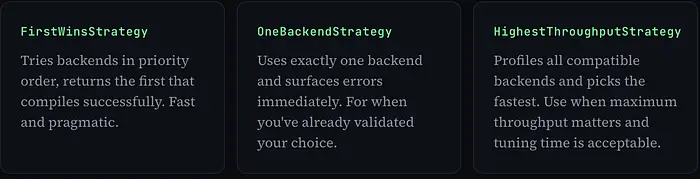

选择逻辑与后端本身一样重要。AITune 暴露了三种后端选择策略:

2.4 AOT vs JIT:选择您的路径

两种模式最终都会产生优化模型,但权衡是显著的。以下是官方文档的完整比较:

3、更广阔的图景:AITune 的位置

值得精确说明 AITune 是什么不是什么,因为 NVIDIA 已经有密集的推理工具生态系统:TensorRT-LLM 用于大型语言模型,Triton 推理服务器用于多模型服务,Dynamo 用于数据中心的分布式推理。

AITune 占用不同的市场。它针对没有专用服务框架的通用 PyTorch 模型——视觉骨干、自定义 BERT 变体、Stable Diffusion 管道开发者知道模型能���作但没有投入基础设施级优化。 README 明确指出:如果您的模型受益于运行时优化如连续批处理或投机解码,使用 TensorRT-LLM、vLLM 或 SGLang。AITune 适用于其他一切。

AITune 代表的转变不仅仅是关于性能——而是让推理优化对训练模型的工程师可用,而不仅仅是部署它们的基础设施专家。

这种民主化的角度被低估了。今天,严重的推理优化需要专业知识了解 TensorRT 的 ONNX 解析器怪癖,知道 torch.compile 何时会点击图形断点,在动态和静态形状配置文件之间选择。 AITune 将专业知识封装在一个简单运行和测量的基准测试循环中,消除了优化周期中的人为瓶颈。

4、先决条件和安装

AITune 目标 Linux 环境(Ubuntu 22.04+)并需要 Python 3.10+、PyTorch 2.7+ 和 NVIDIA GPU。对于 TensorRT 后端支持,需要 TensorRT 10.5.0 或更高版本。NVIDIA 推荐使用他们的 PyTorch NGC 容器,其中包含所有预配置的依赖。

# 从 PyPI 安装(推荐)

pip install --extra-index-url https://pypi.nvidia.com aitune

# 或从源码安装

git clone https://github.com/ai-dynamo/aitune

cd aitune

pip install --extra-index-url https://pypi.nvidia.com .

5、早期注意事项要关注

这是 v0.3.0 首次公开发布,README 坦率地说明了局限性。JIT 模式没有缓存每个新的 Python 解释器从头开始调优过程, 这在冷启动时增加了开销。JIT 模式也不能执行完整基准测试,因为它无法直接访问数据加载器,这意味着 HighestThroughputStrategy 在该模式中不可用。

API 也明确标记为可能不稳定:"这是第一次发布。API 可能会在未来的版本中更改。"对于生产管道,这意味着 AOT 路径及其保存的 .ait 检查点——是更安全的生产选择,而 JIT 非常适合实验和快速评估。

部署可移植性是另一件需要记住的事情:NVIDIA 建议在与调优相同的硬件类上部署 .ait 包,因为 TensorRT 引擎计划是 GPU 特定的。跨硬件可移植性需要重新调优。

6、结束语

AITune 是那些让你想知道为什么五年前不存在的工具之一。它解决的问题——"哪个推理后端实际上对我的特定模型在我的特定 GPU 上最快?" 是通用的,答案一直很难获得。自动化基准测试循环,用干净的 API 包装它,并在 Apache 2.0 下开源,使其成为 ML 工程生态系统的真正贡献。

JIT 模式特别巧妙:用单个导入语句优化现有 Python 脚本的能力将大大降低进入门槛。对于在生产中持有未优化 PyTorch 模型的团队来说,这是一个低风险、潜在高回报的升级路径。

关注这个项目。ai-dynamo 组织——也是 NVIDIA 分布式推理服务框架 Dynamo 的所在地,显然正在构建从单 GPU 优化到多节点服务的连贯推理工具链。 AITune 是该栈的基础部分,鉴于 NVIDIA 构建强大开发者工具的记录,它可能会快速成熟。

原文链接:NVIDIA Releases AITune: The Toolkit That Automatically Finds the Fastest Inference Backend for Any…

汇智网翻译整理,转载请标明出处