OpenClaw-RL让智能体自我改进

OpenClaw-RL 恢复了每个智能体系统都在浪费的东西:下一个状态信号。而且它在您还在交谈时就能做到。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

OpenClaw-RL 恢复了每个智能体系统都在浪费的东西:下一个状态信号。而且它在您还在交谈时就能做到。

关键在于:您部署的每个 AI 智能体都已经坐拥丰富的训练数据宝藏。每一次交互。每一个用户回复、每一个工具执行结果、每一个终端输出、每一次 GUI 状态变化。全都在那里。丰富、结构化、免费。

而每个系统都在丢弃它。

用户说"不,我指的是另一个文件。"这是一个训练信号。测试套件在智能体代码编辑后返回堆栈跟踪。训练信号。终端吐出一个退出代码。训练信号。所有这些都被当作"下一个动作的上下文"丢弃了。没有转换为梯度。没有用于更新权重。只是……被消费和遗忘。

普林斯顿的一个团队刚刚发表了一篇论文,让这种浪费无法被忽视。OpenClaw-RL。与大多数用新首字母缩略词重新包装现有想法的论文不同,这篇论文实际上指出了整个智能体 RL 社区一直在忽视的一个根本性问题。

1、"下一个状态信号"到底是什么?

简单来说。智能体采取动作 a_t 后,会发生一些事情。用户回复。工具返回输出。GUI 转换。这个"某事"就是下一个状态 s_{t+1}。在用于 LLM 的标准 RL 中,这个信号要么被完全忽略,要么在长轨迹的最后被简化为最终结果奖励。

OpenClaw-RL 认为这个信号携带两种不同形式的可恢复信息。首先,评估信号:动作是否有效?用户的重新查询意味着不满。通过的测试意味着成功。PRM 可以逐轮将这些转换为标量奖励。其次,指导信号:动作应该如何不同?当用户写"你应该先检查文件"时,这不仅仅是一个差评。它告诉您哪些令牌应该改变以及如何改变。标量奖励无法捕捉这一点。您需要更丰富的信息。

说实话,评估部分并不完全是新的。PRM 已经在数学推理领域研究了一段时间。但将它们作为跨异构交互流(对话、终端、GUI、SWE 任务、工具调用)的实时在线过程奖励同时应用?这不是通常的"我们在固定数据集上训练"的故事。这次是实时的。

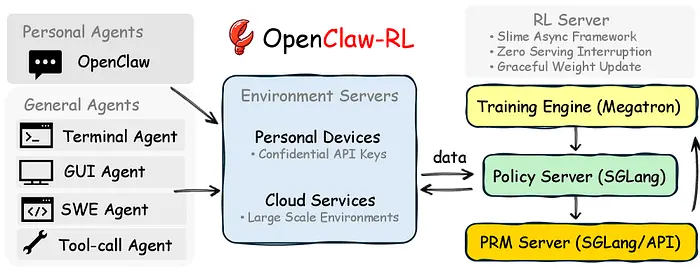

2、使其工作的架构

OpenClaw-RL 建立在 slime 异步框架之上,它将所有内容解耦。四个独立的循环运行,零阻塞依赖:

模型为您的下一个请求提供服务,而 PRM 评判您之前的响应,训练器应用来自两次交互前的梯度更新。没有组件等待另一个组件。对于个人智能体,您的设备通过机密 API 连接。对于大规模通用智能体,数百个并行环境在云服务上运行。

哦!而且它将每个 API 请求分类为"主线"轮次(可训练:实际响应和工具执行)与"辅助"轮次(不可训练:内存组织、辅助查询)。所以它确切地知道应该从什么中学习。

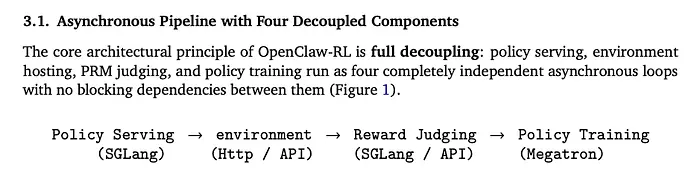

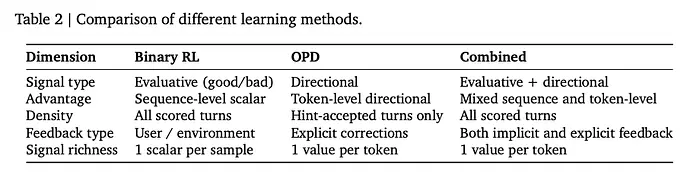

3、二元 RL:粗糙但可靠的信号

PRM 根据下一个状态反馈评估每个智能体响应。用户似乎满意吗?工具调用成功了吗?评判器给它评分:+1(好)、-1(坏)或 0(中性)。通过多数投票进行多次独立评估以提高鲁棒性。

这些标量奖励馈入具有非对称边界的 PPO 风格裁剪代理损失。标准的东西,众所周知的优化。二元 RL 接受每个评分的轮次,适用于任何下一个状态信号,包括简短的响应,并提供广泛的梯度覆盖。

但问题是:它很粗糙。每个序列一个标量。当用户说"你应该在编辑之前先检查文件"时,二元 RL 给您一个 -1。就是这样。关于什么需要改变以及如何改变的所有方向信息?丢失了。

4、后悔引导的同策略蒸馏:秘密武器

这就是 OpenClaw-RL 真正聪明的地方。OPD 恢复了二元 RL 丢弃的指导信息,而且它不需要单独的、更强的教师模型。

四个步骤。

- 第一步:评判器从下一个状态信号中提取简短的"提示"(1-3 句可操作的更正)。- 第二步:质量过滤;只有具有明确可提取更正方向的轮次才能通过。- 第三步:提示被附加到原始提示上,创建一个"增强的教师上下文";如果用户提前给出了更正,模型会看到的内容。- 第四步:在这种增强的上下文下查询策略模型,"教师"(提示增强)和"学生"(原始)分布之间的逐令牌对数概率差距成为优势信号。

A_t = log π_teacher(a_t | s_enhanced) - log π_θ(a_t | s_t)

这很美妙,因为它是自蒸馏。没有外部教师。没有预先收集的反馈对。模型使用对话中已经存在的后悔来教自己。一些令牌得到强化,其他令牌被抑制。逐令牌方向指导;比单个标量丰富无限倍。

但是等等。OPD 很挑剔。它只在存在明确更正方向的轮次上训练。样本稀疏。这就是为什么您需要同时运行两种方法。

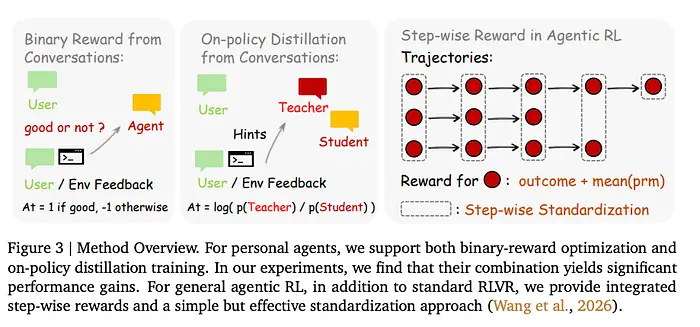

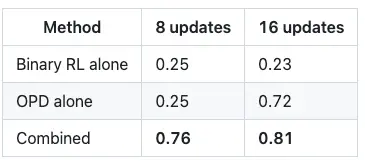

5、组合方法改变了数字

数字不会撒谎。从基础个性化评分 0.17 开始:

我们是认真的吗?单独的二元 RL 在 16 步后实际上会下降。单独的 OPD 显示延迟的收益(稀疏样本,还记得吗?)但最终会急剧上升。但是组合?仅 8 次更新后达到 0.76。从 0.17 开始。

具体来说:一个使用 OpenClaw 做作业的学生只需要 36 次问题解决交互,智能体就学会了停止听起来像 AI(不再有"粗体"格式,不再有机械的逐步步骤)。一个批改作业的老师只需要 24 次交互,智能体就开始写更友好、更具体的反馈。学生场景从 0.17 跳到 0.76。老师从 0.22 跳到 0.90。

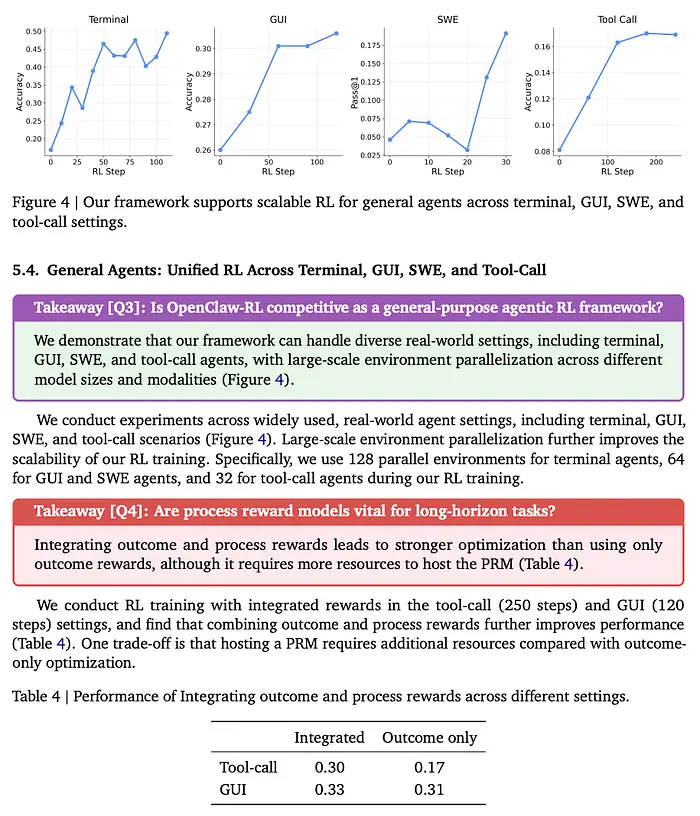

6、不仅仅是个人智能体

同样的基础设施通过大规模并行化处理终端、GUI、SWE 和工具调用设置中的通用智能体 RL(终端 128 个环境,GUI/SWE 64 个,工具调用 32 个)。不同设置使用不同模型:终端使用 Qwen3-8B,GUI 使用 Qwen3VL-8B-Thinking,SWE 使用 Qwen3-32B。

对于通用智能体,他们将过程奖励与结果奖励集成。工具调用的结果:集成奖励为 0.30,仅结果奖励为 0.17。这仅通过添加逐步 PRM 信号就提高了 76%。绝对数字并不惊人,但方向性证据很清楚:过程奖励对于长视野智能体任务很重要,而 OpenClaw-RL 使它们在实践中大规模可行。

7、为什么这真的很重要

每个智能体框架现在都通过内存文件、系统提示和技能库进行适应。基础模型权重永远不会改变。OpenClaw-RL 改变权重。在使用它的同时。不中断服务。

整个堆栈(策略模型、评判器、训练器)在您自己的基础设施上运行。没有第三方 API 调用。您的对话数据保持本地。并且所有内容都实时记录到 JSONL 以实现完全可观察性。

这是第一个在同一个循环中统一个人智能体个性化和通用智能体训练的系统,来自相同的下一个状态信号,跨异构交互类型。对话、终端、GUI、代码仓库、工具调用;它们只是具有不同转换函数的 MDP。训练信号是通用的。

通过使用而改进的智能体不再是研究原型。它是开源的,它是异步的,它在您的硬件上运行,它从您已经生成和丢弃的数据中学习。

这是我的观点。您应该做您觉得舒服的事情。但如果您正在构建智能体系统并且您没有恢复下一个状态信号进行训练,您正在将最自然、最丰富、信息最丰富的监督源留在桌面上。OpenClaw-RL 刚刚向您展示了如何捡起它。

原文链接: OpenClaw-RL: AI Agent Is Throwing Away Its Best Training Data汇智网翻译整理,转载请标明出处