在树莓派上运行OpenClaw

本文描述了在树莓派4上安装和运行OpenClaw,使用本地语言模型通过Ollama或云提供商LLM服务。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

在过去几个月里,感觉互联网上的每个人突然都在某处运行着AI代理。

人们展示的典型设置是一台强大的工作站或Mac mini持续运行,而代理连接到电子邮件、文件、消息应用和浏览器。这个承诺很诱人:一个永不休眠的数字工作者,自动化重复性任务。

这种安排可行,但假设始终在线的计算机可用于实验,这可能并不总是可行的。或者人们可能无法在包含个人或敏感信息的机器上测试代理框架,并且该机器可以持续运行。特别是对于早期实验。

这就是树莓派上用场的地方。

本文描述了在树莓派4上安装和运行OpenClaw,使用本地语言模型通过Ollama或云提供商LLM服务。在第一种情况下,系统旨在实验而非性能。目标是观察代理框架在保持环境低成本和隔离的情况下的行为。一旦测试和配置完成,如果需要,可以在第二种情况下运行系统。

结果是一个简单的实验设置,让您可以探索OpenClaw而无需Mac mini或强大的专用机器。

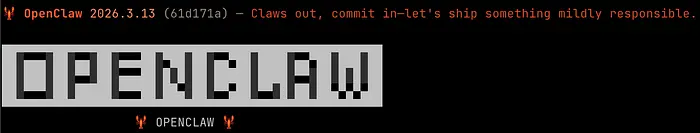

1、OpenClaw是什么

OpenClaw不是由LLM驱动的聊天机器人。它更接近于代理的操作系统。

OpenClaw是一个处于实验阶段的开源项目。图片由作者改编。

与等待提示词的ChatGPT不同,OpenClaw在后台持续运行。它按计划执行任务,监听事件,并与文件、终端、API和消息应用等工具交互。

从概念上讲,它充当自主代理的控制平面。

以下是OpenClaw的详细情况:

1. 它实际上是什么(而非炒作)

不是聊天机器人,而是代理: OpenClaw是一个开源的AI代理"控制平面"或操作系统,常用于连接Claude或GPT等模型到消息应用(Telegram、Slack、WhatsApp)。

始终在线: 与等待提示词的ChatGPT不同,OpenClaw使用"心跳"(轮询)和"定时任务"在后台运行以自主执行计划任务。例如:

- 读取收到的邮件

- 检查Slack频道

- 监控文件夹中的新文件

- 每小时触发一个操作

"数字工作者": 它可以代表您读取邮件、浏览网页、管理日历并编写代码来解决问题。

- 读取消息并总结它们

- 搜索网络来弄清事情或做研究

- 编写脚本

- 组织文件

- 触发工作流

因此,代理成为可编程的工作者,而不是对话界面。

- 持久记忆: 它使用本地Markdown文件(

SOUL.md、MEMORY.md)在会话之间维护记忆,使其感觉"活着"或持续,而不是像浏览器聊天那样重置。

这些文件充当持久上下文。代理不会在交互之间丢失状态,而是可以跨会话积累知识。

2. "危险的"现实(安全风险)

- "困惑的代理": 因为它可以访问您的文件、终端和API密钥,被入侵的OpenClaw实例可能导致主机机器的完全接管。

- 大量漏洞: 早期、未打补丁的版本将"localhost"管理面板暴露在公共互联网上,导致数千个实例被入侵。

- 提示词注入: 代理可能被恶意邮件或网站欺骗(例如,邮件中隐藏的白色文本提示词)从而做出违背您利益的行为。

- 不安全的"技能": ClawHub社区市场提供"技能"(插件),已被证明包含高比例的恶意脚本。

3. 实用性和成本

- 不适合初学者: 它需要终端/命令行熟练度来设置、保护和故障排除。

- 高令牌成本: 它"消耗令牌"。如果没有正确监控或配置,它很容易陷入"推理循环",花费数百美元的API费用。

- "过度自主": 它可能静默失败或过度纠正,做出难以信任的决策,需要持续监督。

4. 未来

- OpenAI参与: 项目创建者加入OpenAI从事个人代理工作,但OpenClaw在新的独立基金会下保持开源。

- 转型中: 它正从病毒式玩具转变为更有结构、基金会支持的项目,但安全仍然是主要关注点。

要点对于技术娴熟、想要"随意编码"和探索自主AI前沿的个人来说,它是理想的选择,但应该在容器化/隔离环境(如便宜的VPS或RPi)中运行,而不是在当前状态下连接敏感的真实数据(如主要邮件或银行)。

2、一些需要考虑的事情

社区插件

生态系统包括代理技能和插件市场。这些脚本中有许多未经审计。一些研究表明,其中很大一部分包含不安全代码。

盲目运行这些相当于从互联网运行随机shell脚本。

令牌成本和失控循环

代理通常迭代推理。如果循环条件没有明确定义,代理可能会在尝试解决任务时重复调用模型。这可能导致意外巨大的API成本。因此,首先在本地实验是明智的做法。

如果您打算使用云提供商作为LLM,如anthropic/OpenAI,请确保为您的积分设置限制。您可以在OpenClaw内部做类似的事情。

这是一个非常早期的教训。例如,您可能会被诱惑使用非常强大的模型作为默认值,如Anthropic的Opus模型,您会非常快地消耗您的令牌。

3、什么时候值得运行OpenClaw

OpenClaw对于实验和工作流自动化最有用。

典型有意义的情况包括:

- 学习自主代理在真实环境中如何行为

- 为个人生产力构建小型自动化工具

- 测试LLM和真实应用之间的集成

- 探索代理架构和编排循环

- 原型研究想法

在这些情况下,目标不是可靠性而是探索。

对于对AI系统设计感兴趣的工程师来说,这也是理解代理实际是什么的宝贵方式。

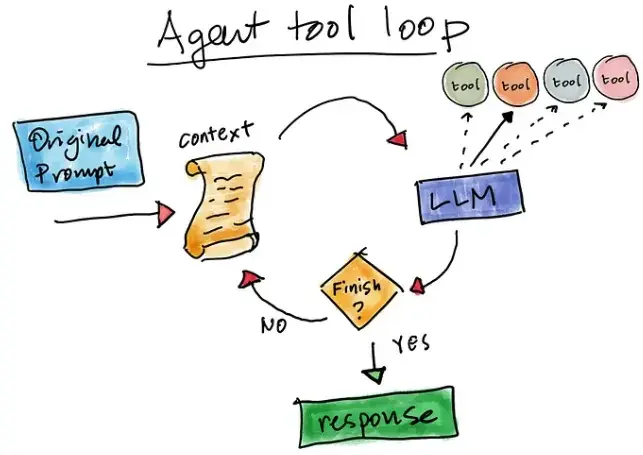

在底层,代理通常只是循环中的LLM,重复地:观察状态、选择操作、执行工具、更新提示词。如果您想了解更多关于代理循环的信息,请查看这里。

代理工具循环概念。 在AI代理内部,循环中有一个LLM根据操作(工具)的后果做出决策以完成任务。每次迭代时,上下文都会更新任务状态和操作结果。图片由作者创建。

运行像OpenClaw这样的系统使这种架构非常清晰。

4、主要用例

即使处于实验形式,OpenClaw也可以自动化惊人数的工作流。一些例子包括:

个人研究助手: 代理可以监控RSS源或研究存储库,并将新论文/帖子总结到知识库中。

文件组织: 代理可以扫描文件夹、分类文档并将它们移动到结构化目录中。当您想要组织Obsidian库时,这个很有用。

邮件分类: 代理可以读取收到的邮件并生成摘要/草拟回复。我还没有将OpenClaw连接到我的个人邮件,目前我正在使用专用的安全邮件账户进行测试。

开发助手: 系统可以监控存储库并自动运行测试、格式化代码或生成文档。

信息仪表板: 代理可以定期从API收集信息并生成报告。我觉得这个需求很大。有几个人让我为他们创建类似的东西。

报告生成: 收集信息并创建摘要,以指定格式放置在指定目录中。这是迄今为止我最喜欢的用例。我在RPi上安装了Obsidian,我有一个项目报告部分,用于我感兴趣的项目(例如安全审计、时间表摘要等)。

这些任务效果很好,因为它们结构化且低风险。

5、在树莓派上运行OpenClaw

这是我的低成本实验设置,用于在OpenClaw中玩转专用代理。

我的OpenClaw在树莓派4上运行。您可以看到我的旧RPi 4,配有256GB SSD(装在铝制外壳中,通过usb-C连接),仍然安装在我用于另一个项目的Pi Cluster机架中)。后面的PC是我在Ollama上运行本地LLM的地方。也是低成本方法。

硬件

- 树莓派 4 * 256GB SSD

- 线缆(HDMI、电源、USB-C)

- 鼠标和显示器用于初始设置(之后无头运行)

模型运行时

对于本地LLM,您可以在台式计算机上运行Ollama,并可以将OpenClaw设置为从Pi远程访问语言模型。您可以在下面进一步了解这里。或者,您可以从云提供商运行更强大的LLM。为此,您需要来自anthropic、openAI等的API密钥。

在SSD上安装树莓派OS

树莓派OS直接安装在SSD上,而不是microSD卡上。SSD提供更高的可靠性和更快的存储访问。

首先需要安装(我必须擦除我的PiCluster主节点)。请参阅该项目的快速介绍。

如果您从未在RPi上安装操作系统,可以阅读安装步骤这里。基本上,您需要一个应用程序将OS镜像复制到micro SD卡或外部SSD(在我的情况下)。

一旦您在Pi上运行raspbian(或操作系统),您可以配置网络设置和ssh,以便从另一台计算机连接(无头)或者如果您想直接操作,则需要设置显示器和键盘(如果您更喜欢窗口管理器,也可以用鼠标)。

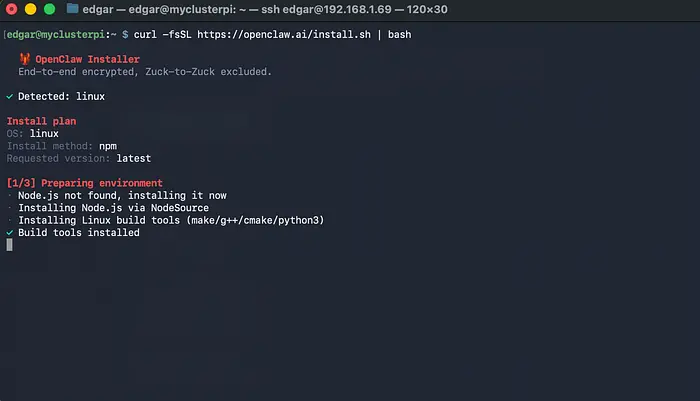

完成所有这些后,您可以在终端中运行以下命令 curl -fsSL https://openclaw.ai/install.sh | bash

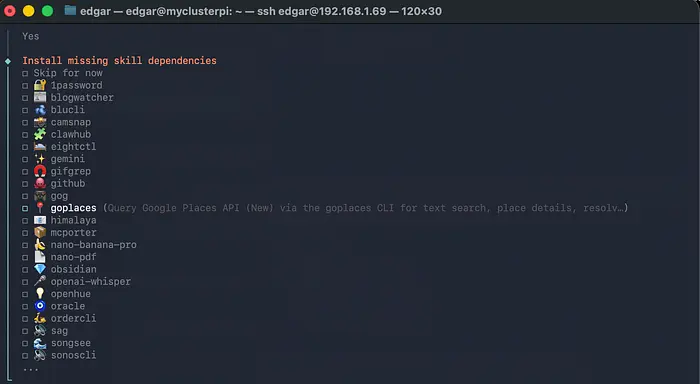

OpenClaw安装 过程简单,如果您知道自己在做什么。我做了好几次。小规模开始的另一个好处 :)

完成基本安装步骤后,您可以看到OpenClaw正在运行

OpenClaw安装完成。

OpenClaw有非常流畅的安装过程。它有指导步骤来设置一切。也许最重要的部分是给它访问LLM(本地或基于云的服务,如Anthropic/OpenAI)。我在另一台机器上本地运行ollama小模型,所以我尝试使用GM flash模型。

6、使用Ollama本地运行LLM

虽然您可以在树莓派上运行Ollama,但对于单个小RPi 4来说可能太多了。所以,我在单独的PC上运行ollama。

连接到Ollama

语言模型在台式计算机上通过Ollama运行。树莓派向Ollama API发送请求。

台式机提供更多内存和CPU资源,允许更大的模型高效运行。Pi执行编排任务和调度。

首先使用本地模型尝试OpenClaw。图片由作者改编。

我在比RPi有更多内存的PC上运行Ollama :) 所以为了避免在使用积分时产生高昂费用,我决定在本地完成所有这些操作,一旦我了解更多关于风险和配置方法后再升级到更强大的模型。

首先尝试使用GLM 4.7 Flash(30B参数,3B激活MoE模型),对于其大小来说推理能力非常出色

我安装了最小技能、使用Brave search API的网页搜索。为此您需要创建账户并获取API密钥。将积分限制设置为每月5美元,有免费的5美元积分。

7、PicoClaw

PicoClaw是OpenClaw的简化版本,依赖更少,系统要求更低。它提供基本的代理功能,无需完整框架。

此变体适用于树莓派等受限硬件。它对于快速实验和小型自动化任务也很有用,在这些情况下完整的OpenClaw堆栈是不必要的。OpenClaw有多个变体,每个都针对不同的目标。

8、树莓派设置的优缺点

树莓派功耗低,可以持续在线。硬件便宜且易于更换。在单独设备上运行框架将实验软件与主工作站隔离。

树莓派内存和CPU容量有限。本地运行较大模型不实际。需要大量计算的任务执行缓慢。通常需要远程模型主机。

在实践中,该设备作为编排节点运行良好,但不适合作为模型服务器。

9、结束语

当前的代理框架浪潮造成了一种印象,即需要昂贵的硬件才能参与。

实际上,实验可以从更简单的东西开始。

树莓派完全能够运行代理系统的编排层,而更重的模型推理发生在其他地方。

这种设置还引入了一个重要的原则:

代理应该被视为实验系统。它们需要隔离、监控和仔细配置。

因此,在小型专用机器上运行它们不仅更便宜,而且通常更安全。

对于任何好奇自主代理实际如何工作的人来说,我发现这种设置是在不投入大量资源的情况下探索技术的实用方法。随着我继续实验和学习,我的观点可能会改变,但现在我会建议从小规模开始。

网上关于openclaw的内容太多了,很容易让人觉得如果没有像其他人一样运行代理,那么所有的工作都会被简化,然后你会有很多时间做其他所有事情(我不同意最后一部分)。

无论如何,这种小规模低成本方法是开始和学习的好方法。

原文链接: You do not need to buy a Mac mini to run OpenClaw

汇智网翻译整理,转载请标明出处