强化学习环境的商业运作

我认为我们正处于一个转折点。那些能够找到如何扩展强化学习环境创建的实验室将在训练方面拥有显著优势。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

你使用的每一个前沿模型背后,都隐藏着一个庞大的产业。当 Claude 的编码能力不断提升,当 GPT 的数学运算能力不断增强,当 Gemini 的工具使用能力不断提高——这一切并非凭空而来。必须有人构建训练环境,才能让这些改进成为可能。而现在,这个“构建者”是少数几家规模较小、大多保持低调的公司,它们与大型实验室签订了合同。

过去几年,我一直专注于 GPU 编程——我为 FreeCodeCamp 制作了一门 12 小时的 CUDA 课程,正在与 Manning 出版社合作撰写《CUDA for Deep Learning》,并且开发了 KernelBench v3,一个多平台 GPU 内核基准测试套件。所有这些工作都围绕着同一个问题:如何严格评估代码是否真正有效,以及如何大规模地进行评估?这个问题正是强化学习环境设计的核心所在。

我将根据公开信息解释这种商业模式的运作方式、其重要性,以及为什么我认为下一代模式看起来更像是一个庞大的分布式团队,而不是精品外包公司——可能有成千上万的人为他们擅长的领域构建强化学习环境。

1、什么是强化学习环境?

让我们从零开始。

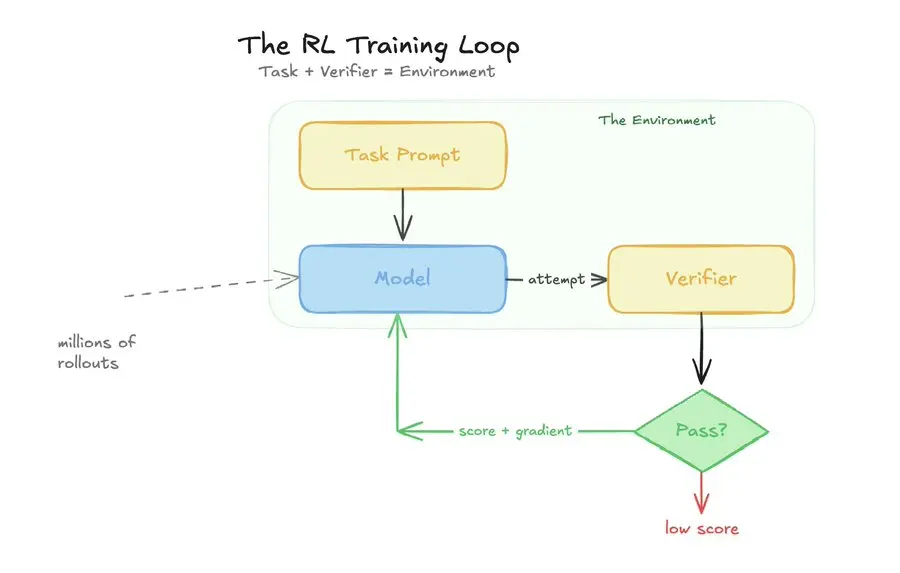

当你使用强化学习微调语言模型时,你需要三样东西:一个让模型尝试的任务、一种对模型输出进行评分的方法,以及一个反馈循环,该循环通过数百万次的尝试推动模型获得更高的分数。

“任务 + 评分器”的组合就是强化学习环境。你可以把它想象成模型的健身房。

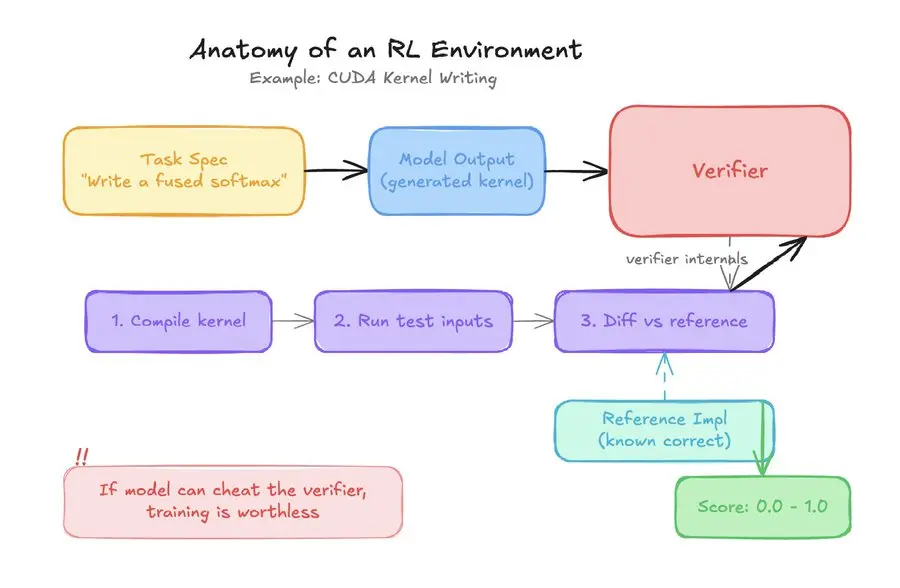

这里有一个具体的例子。假设你想让你的模型更好地编写 CUDA 内核。您的环境可能如下所示:

- 任务:“编写一个 CUDA 内核,对形状为 (B, H, S, S) 的张量执行融合 softmax 操作,其中 B 代表批次大小,H 代表头部数,S 代表序列长度。”

- 参考实现:一个正确且经过优化的内核,能够针对已知输入产生已知输出。

- 验证器:一个程序,用于编译模型提交的内核,在一组测试输入上运行该内核,检查其数值正确性(在浮点容差范围内)并与参考实现进行比较,还可以选择性地测试吞吐量。

- 评分:基于正确性的二元通过/失败,或基于相对于参考实现的性能的连续评分。

模型生成数千次尝试。验证器对每次尝试进行评分。梯度流动。模型编写 CUDA 内核的能力不断提高。在数百个不同的内核任务中重复此过程,即可显著提升模型的 GPU 编程能力。

关键约束:验证器必须不可被奖励机制操纵。如果模型能够找到一条捷径,无需真正解决问题就能获得高分——例如返回硬编码的输出、利用测试套件中的边界情况、寻找测试输入中的模式——那么整个验证过程就失败了。你是在训练模型作弊,而不是让它编写代码。

构建一个好的验证器比听起来要难得多。我对此深有体会。

2、验证器为何如此困难:来自Minecraft 的启示

当我构建 KernelBench v3 时,核心挑战并非编写内核,而是构建可靠的评估机制。你需要能够覆盖边界情况的测试用例、既能捕捉到 bug 又能处理硬件上合理的浮点运算误差的数值容差,以及真正公平的性能基准。验证器中每一个偷工减料的地方,都可能成为模型训练时利用的作弊手段。

但内核验证其实相对简单。你有确定性的输入、(近似)确定性的输出,以及清晰的正确性标准。在开放式领域,难度会大大增加。

我最近尝试用VibeCode编写一个Minecraft克隆游戏,这完美地诠释了验证器问题。Minecraft的游戏逻辑看似简单,实则复杂——方块物理、合成配方、生物AI、红石电路、物品栏管理等等。如果你想构建一个强化学习环境,让模型学习如何玩Minecraft(收集资源、合成物品、生存、最终击败末影龙),那么你的验证器需要正确地模拟所有这些内容。而“正确”是一个不断变化的目标——你的验证器能否处理苦力怕炸毁模型即将使用的工作台这种极端情况?它能否精确到游戏刻度地控制熔炉熔炼?

我尝试用AI帮助我构建哪怕是简化版的Minecraft克隆游戏,这段经历让我清楚地认识到:瓶颈在于工具,而不是概念本身。“训练模型玩Minecraft”的想法其实很简单。构建一个能够流畅运行数百万次强化学习部署的无头 Minecraft 服务器,并配备一个能够正确评估模型是否真正达成目标的验证器,这本身就是一个巨大的工程挑战。而这仅仅是针对一个规则明确的游戏而言——试想一下,如果要为创意写作、战略谈判或科学研究构建验证器,难度又会有多大?C语言推理。

这就是为什么某些领域目前还不适合强化学习环境的原因。并非因为这些领域不重要,而是因为我们没有构建可靠验证器所需的工具。验证器问题本质上是一个工具问题,而强化学习训练效果最佳的领域,恰恰是那些验证成本最低、可靠性最高的领域——代码执行、数学证明、具有确定性规则的游戏结果。

3、目前业务运作方式

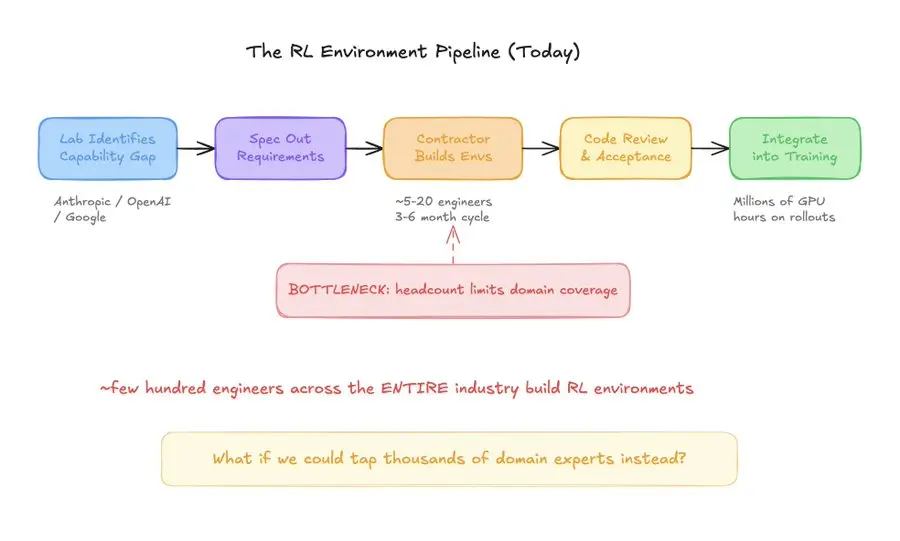

根据公开信息——招聘信息、研究论文、会议演讲以及实验室的一般运作结构——前沿实验室的强化学习环境流程大致如下:

- 实验室识别能力差距。研究人员决定希望他们的模型在以下方面有所改进:例如,多文件代码库导航、长期规划或形式化证明编写。

- 他们制定环境需求规范。哪些领域、难度分布如何、验证器需要检查什么、哪些边界情况至关重要。

- 一家外包公司负责构建环境。一个小型工程师团队——通常是领域专家,例如构建内核环境的 GPU 程序员或构建算法环境的竞技编程人员——负责设计和实现完整的环境套件:任务生成器、参考解决方案、验证器和测试框架。

- 代码审查和验收。实验室审查提交的环境。他们检查是否存在奖励作弊漏洞、测试覆盖率、参考解决方案的正确性,以及难度分布是否真正符合他们的需求。

- 集成到训练中。验收的环境将被接入实验室的强化学习 (RL) 训练基础设施。模型将针对这些环境运行数百万次的部署。这是计算成本最高的部分,但它是完全自动化的。训练过程中无需人工干预。

承包商在验收后获得报酬。实验室的能力得到提升。

问题在于?这种模式无法扩展。

目前,整个行业可能只有几百名工程师在为前沿模型构建强化学习环境。对多样化、高质量环境的需求增长速度远远超过了构建这些环境的人才供应速度。实验室想要改进的每个新领域都需要特定领域的专业知识。你不可能让同一个 CUDA 内核专家同时构建用于医学推理、法律分析或博弈论的环境。

4、分布式模型:如果成千上万人构建环境会怎样?

有趣的地方就在这里。xAI 有一个导师项目——他们雇佣人员来处理 RLHF 数据,基本上就是对模型输出进行评分并提供演示。这是人工反馈部分。但同样的组织模式也适用于强化学习环境。

想象一下:你不再需要委托公司构建内核环境,而是发布赏金。“我们需要 500 个用于 Python 算法挑战的强化学习环境,难度范围为 Codeforces 1200-1800,验证者必须能够处理 X、Y、Z 等边界情况,每个被接受的环境奖励 50-200 美元。” 世界各地成千上万的竞技程序员看到赏金后,便开始着手构建。

或者:“我们需要用于《万智牌》游戏状态的强化学习环境,模型必须在其中识别最优解。验证者:从给定状态出发,进行 10,000 局蒙特卡洛模拟,以确认所选解的胜率最高。” 现在,你挖掘到了完全不同的人才库——博弈论专家、万智牌职业选手、以及恰好精通编程和卡牌游戏的业余程序员。

甚至:“我们需要用于《我的世界》资源优化的强化学习环境。给定世界种子和初始位置,模型必须在最少游戏刻内收集并制作目标物品集。验证者:在无头《我的世界》服务器上运行模型的动作序列,并检查物品栏状态。”(祝验证者好运——但这正是它的趣味所在。)

关键在于,领域专业知识在人群中的分布方式与 20 人规模的外包公司的招聘流程并不匹配。最适合构建医学推理环境的人可能是一位业余程序员医生,而不是全职机器学习工程师。

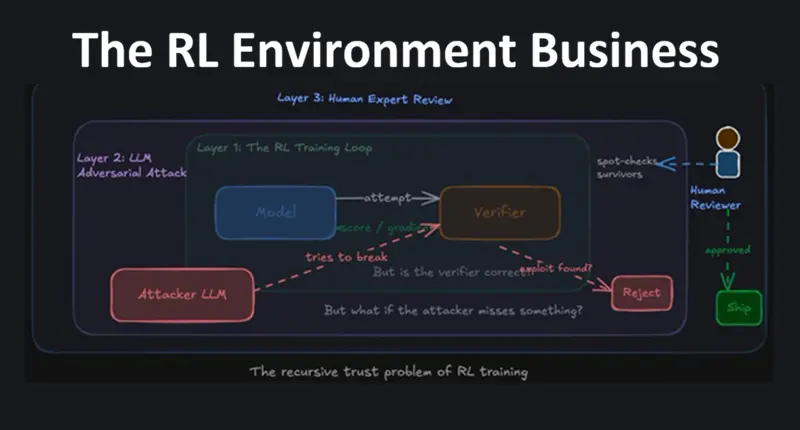

5、难点:大规模验证

好吧,但大家马上都会问:如何验证验证器?

目前的做法是由一小队资深工程师进行彻底的人工代码审查。他们检查验证器的逻辑,尝试找出漏洞,并检查各种边界情况。这种方法适用于每季度审查 50 个环境的情况。但如果每月要审查来自匿名贡献者的 5000 个环境,这种方法就行不通了。

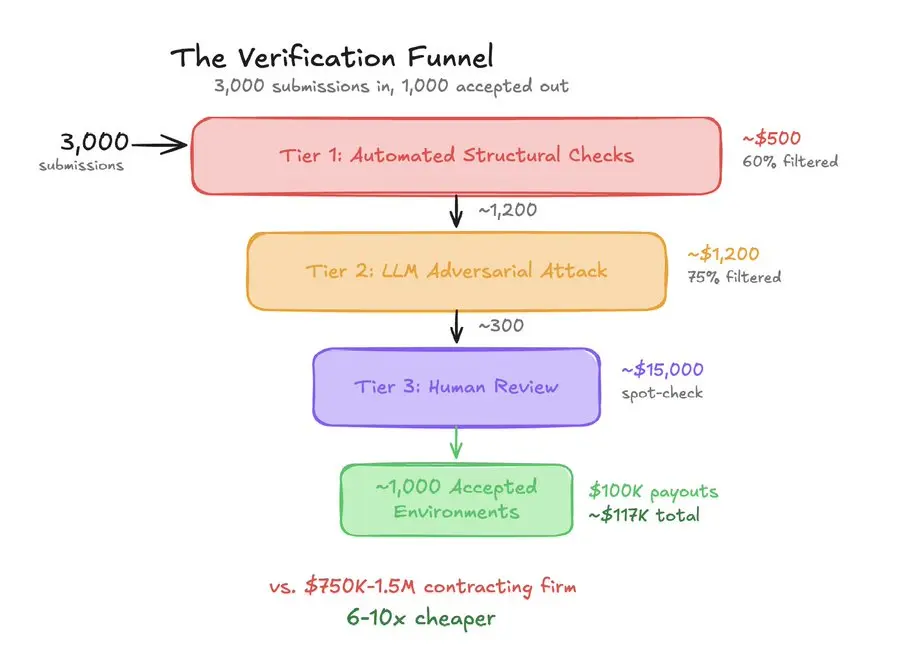

你需要一个大部分自动化的验证流程,只在最后阶段才需要人工干预。以下是我认为可以分层运作的方式:

第一层 — 自动化结构检查(成本:几乎为零)

- 环境是否符合 API 规范?

- 验证器是否符合规范?编译并运行?

- 它是否能正确接受已知的正确解?

- 它是否能正确拒绝已知的错误解(空输出、随机输出、明显错误的输出)?

- 测试套件的覆盖率是否足够?

- 是否存在明显的代码异味——硬编码值、过于简单的逻辑等等?

这大概能检测出 60% 的不良提交。经典的“总是返回 true 的验证器”在这里失效了。

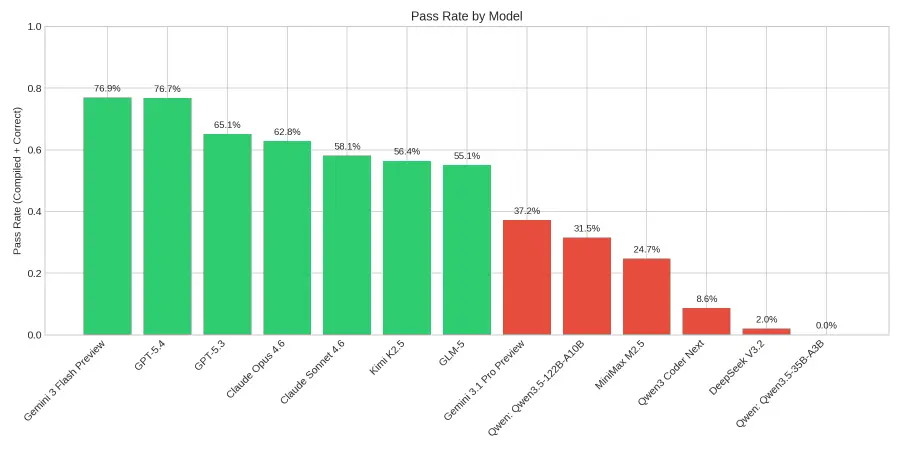

第二层级——LLM 对抗攻击(成本:每个环境约 0.50-2.00 美元)这才是真正有趣的地方。你使用提交的环境,并要求一个前沿模型来破解它。“这里有一个 CUDA 内核正确性的验证器。找到一个通过验证器但实际上没有实现正确内核的提交。”模型会生成对抗解。如果其中任何一个解在不正确的情况下通过了验证器,则该环境审核失败。

目前的模型在这方面表现出色。它们可以识别测试套件的漏洞,找到验证器无法处理的极端情况,并生成奖励破解漏洞。使用LLM攻击强化学习环境,可以说是当前模型最具潜力的应用之一,但却鲜有人提及。

你可以从多个角度进行尝试——不同的攻击策略、不同的模型,甚至可以专门针对验证器漏洞对攻击者模型进行微调。

第三层级——人工专家评审(成本:每个环境20-100美元)只有通过第一层级和第二层级的测试环境才能进入人工评审环节。此时,大约只有10-20%的原始提交环境会经过人工评审。人工评审会检查自动化系统容易忽略的细微问题——难度校准是否正确?任务分布是否具有代表性?测试用例中是否存在隐性偏差?

这种方法的成本效益显而易见。如果你为每个被接受的环境支付贡献者 50-200 美元,并为每次提交的完整验证流程花费 25-100 美元,那么每个已验证环境的总成本可能在 75-300 美元之间。这比聘请外包公司从头开始构建环境要便宜得多,后者每个环境的成本为 500-2000 美元以上(粗略估计,包括工资、管理等费用)。

6、单位经济效益(粗略估算)

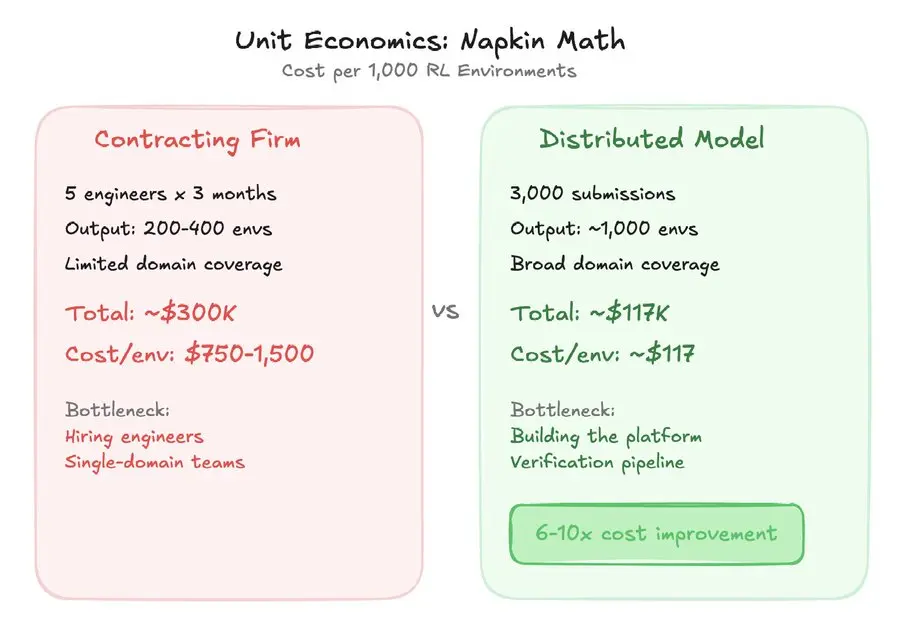

让我们来简化一下。假设你需要 1000 个新的强化学习环境用于编码任务。

外包公司模式:

- 约 5 名工程师,约 3 个月 = 总计约 30 万美元

- 产出:约 200-400 个高质量环境

- 每个环境成本:750-1500 美元

- 瓶颈:招聘和留住工程师,领域覆盖范围有限

分布式模式:

- 发布赏金,收到约 3000 个提交(假设在看到赏金的人群中,尝试率约为 33%)

- 一级自动化过滤:计算成本约 500 美元(微不足道)

- 二级 LLM 对约 1200 个幸存提交进行对抗性审查:约 1200 美元(每个环境约 1 美元,假设每个环境在多次攻击中,按当前 API 费率计算,可能需要 50 万个输入令牌和 20 万个输出令牌)

- 三级人工审查约 300 个幸存环境:约 15000 美元(每次审查约 50 美元)

- 支付方式约 1000 个已接受的环境,平均每个环境 100 美元:10 万美元

- 总计:约 11.7 万美元

- 每个环境的成本:约 117 美元

- 瓶颈:构建平台和验证流程

这大约能带来 6-10 倍的成本提升,而且由于您利用了更大的人才库,因此可以获得更广泛的领域覆盖。这些数字只是粗略估计——实际成本很大程度上取决于接受率、支付结构以及自动化验证的水平——但经济方向非常明确。

在这些环境中进行实际训练的计算成本完全是另一项预算,而且远远超过环境创建成本。在数千个 GPU 上运行强化学习数周需要花费数百万美元。环境本身仅占总训练支出的一小部分,这意味着即使环境创建效率略有提高,也能腾出预算用于更多的训练计算。

7、信任、恶意行为者和安全模型

显而易见的问题:如果有人提交一个故意植入后门的环境怎么办?

威胁模型分为几个层级:

第一层级——懒惰的欺诈。有人提交垃圾数据试图骗取赏金。第一层级的自动化检查可以轻松识别此类情况。

第二层级——巧妙的奖励漏洞利用。有人提交一个看似正确的环境,但其中存在一个细微的漏洞,模型可以在训练过程中利用该漏洞。这是主要威胁。第二层级的LLM攻击专门用于捕获此类漏洞——本质上是对验证器进行模糊测试。

第三层级——对抗性投毒。国家行为体或竞争对手提交专门设计的环境,旨在向训练好的模型中引入细微的偏差或漏洞。这是最可怕的情况,说实话,没有任何全自动系统能够完全捕获所有此类情况。这就是为什么仍然需要第三层级的人工审核,以及为什么最高敏感度的领域(与安全相关的训练、与目标一致性相关的行为)应该由值得信赖且经过审查的团队负责。

有效的防御措施是建立信誉系统。新贡献者从低价值、低风险的赏金开始。他们的生活环境会受到最严格的审查。因为他们的接受率随着贡献的增加,他们的工作也逐渐被证明可靠,他们将获得更高价值的赏金,同时审核成本也会略低一些。但一次被发现的错误提交会永久损害你的声誉。

这基本上就是开源的运作方式。Linux 的新贡献者无法直接提交内核调度器的代码。他们只能修复文档中的拼写错误。信任是通过持续的高质量工作赢得的。

8、目前超出范围的内容

并非所有领域都适合强化学习环境。强化学习环境适用的领域具备以下几个特点:任务目标明确、验证器运行速度快(需要数百万次的测试部署)以及正确性明确无误。代码执行、数学、规则明确的游戏以及形式化证明都符合这些条件。

目前超出范围(或者至少难度极大)的领域包括:任何评估具有主观性的领域(例如创意写作、说服、设计);任何模拟环境本身构建或运行成本过高的领域(例如全保真度的《我的世界》、无法实现仿真到现实迁移的真实世界机器人);以及任何验证者需要超人般的判断力才能正确评分的领域。

我不得不这么说。

不过,这个界限正在移动。更好的工具将更多领域纳入范围。一年前,构建支持多步骤工具使用的环境非常困难。现在,这已经可以解决。两年后,也许有人会破解快速无头《我的世界》模拟,突然间,游戏化的强化学习就能够大规模应用了。

这对前沿实验室意味着什么?

我认为我们正处于一个转折点。那些能够找到如何扩展强化学习环境创建的实验室将在训练方面拥有显著优势。这与拥有更多计算资源无关——毕竟大家都在购买相同的GPU。关键在于获得覆盖更多领域、迭代速度更快、且质量更高的训练信号。

目前,OpenAI、Anthropic 和 Google 都通过小型外包公司和内部团队来实现这一点。虽然可行,但受限于人员配置。例如,像 xAI 这样的新兴实验室(考虑到该公司目前正在进行重组,这或许值得他们考虑),如果从一开始就将分布式环境创建融入工作流程,并在现有导师计划之上构建合适的验证流程和激励机制,则有可能以极低的成本将环境多样性提升 10 倍。

目前还没有实现这一目标的平台。但所有要素都已具备:足以进行对抗性验证的语言学习模型 (LLM);大量愿意以 100-200 美元(对于真正优秀的专家,价格可能更高)的价格构建环境的领域专家;以及如今已成为通用基础设施的容器化执行环境(例如:沙盒化的 Docker 容器,用于安全运行提交的环境)。

总会有人构建出这样的平台。

原文链接:The RL Environment Business

汇智网翻译整理,转载请标明出处