5个最先进的具身AI模拟器

2026年,模拟器已成为AI每年可以安全犯下一百万次错误而不会在真实仓库中犯一次错的唯一场所。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

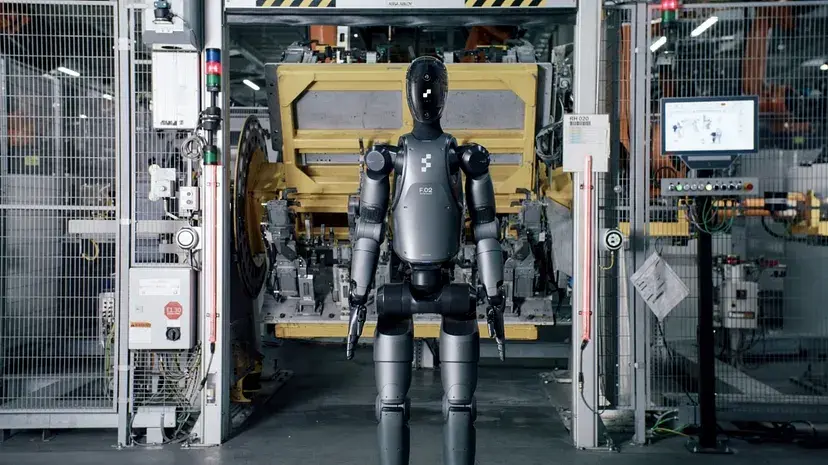

Figure展示了他们的第二代人形机器人如何在宝马装配线上独立安排零部件。为了让这个机器人能够在真实车间中迈出自信的一步,它首先必须在虚拟模拟中进行长时间的训练。

2026年,模拟器已成为AI每年可以安全犯下一百万次错误而不会在真实仓库中犯一次错的唯一场所。每次看到人形机器人自信地绕过程序中未包含的障碍物时,我都会想:它在虚拟模拟中经历了多少次失败?为什么模拟突然变得如此令人信服,以至于AI不再区分像素和原子?让我们探索如何克服模拟到现实的差距,哪些平台正在制定今天的标准,以及生成模型如何构建学习用的世界。

0、模拟到现实的差距

2026年,战胜模拟到现实差距的胜利建立在三大支柱之上:

- 可微分物理。以前,神经网络通过试错学习;现在,物理驱动器告诉AI每个动作需要向哪个方向以及调整多少才能达到理想结果。这加快了训练速度,几个月的开发周期缩短为几天即可获得现成模型。

- 域随机化。为了防止太阳光干扰机器人,开发人员故意使模拟变得"不完美"。光线闪烁,地板纹理变化,重力"浮动"。在Isaac Sim 5.1版本中,NVIDIA引入了工具,故意扭曲完美画面,向模拟中添加物理镜头缺陷、数字噪声和颜色失真。这迫使AI在不完美的照明和光学条件下训练,准确模拟仓库或工厂中真实摄像头的操作。这种方法确保在模拟中训练的AI将在真实设备上稳定运行,无需额外适应,因为机器人已提前为真实世界的视觉混乱做好准备。

- 传感器保真度。2026年,AI模型学会了通过触觉"感受"世界。Sharpa Robotics证实,新一代触觉传感器的分辨率比人类指尖高5倍。这使模拟器能够感知羽毛重量的力。对于企业来说,这是向自动化的过渡,因为现在机器人可以在虚拟环境中磨练脆弱电子产品或医用安瓿的操作,而不会压碎真实负载或因抓握不足而掉落。

然而,即使最先进的模拟器也需要来自真实世界的清晰数据进行验证。这就是Keymakr等公司提供的服务发挥作用的地方,它们对真实世界视频数据进行高精度标记。这使得机器人的"数字体验"可以与真实场景进行比较,确保模拟的感官模型100%准确。

2026年市场领导者回顾

如今,选择模拟器不是由公司预算决定,而是由您计划为机器人配备的特定技能决定。

1、NVIDIA Isaac Lab (Omniverse)

如果您的机器人必须在视觉效果至关重要的环境中工作,例如按颜色分拣商品或在困难照明条件下工作,就使用它。

Omniverse平台、Isaac Lab允许您在单个GPU上运行数千个并行模拟。这是复杂人形机器人的训练场,在几小时内,它们完成了在现实中需要数十年的学习路径。适用于大型仓库和复杂装配线。

Figure 02人形机器人的案例证实了这一点。NVIDIA官方声明Isaac Lab堆栈用于为该机器人在宝马工厂工作做准备。由于能够运行数千个并行模拟,Figure 02的训练被极大加速。这使机器人能够进入真实的宝马装配线,立即执行金属零件的复杂操作,同时忽略车间地板上的视觉噪声和眩光。

2、Google DeepMind / MuJoCo 3.0+

MuJoCo是研究人员关心的"黄金标准",他们关注机器人手指如何精确抓取物体。在3.0+版本中,Google集成了MJX(JAX上的MuJoCo),使其能够将计算卸载到加速器(TPU/GPU)。这使模拟器在强化学习(RL)中变得快速。它比其他任何模拟器都更准确地计算接触物理,如摩擦、滑动和压力。非常适合开发精细运动技能。

真实世界的证据是Google DeepMind在训练多指机器人手方面的成功。由于微物理接触的计算,AI学会了在手指间旋转物体和解决魔方。对于企业来说,这为电子产品的微组装和复杂手术模拟的自动化开辟了道路,其中按压力很重要。

3、Genesis

Genesis将开源的便捷性与GPU加速的强大功能相结合。它在单个RTX 4090上提供高达每秒4300万帧的速度。原生支持固体、流体、织物和软体机器人。适合初创公司和快速原型制作。

正如案例研究所证明的,Genesis开发团队展示了该引擎可以同时计算数千次交互,例如金属爪子将水倒入玻璃杯、切割软面团以及与织物交互。由于惊人的速度,现在可以训练以前需要整个服务器集群的厨房或实验室机器人助手。

专业平台

有些平台专为特定条件设计:家庭导航和与人交互。如果您的机器人应该为办公室送咖啡或在家中提供帮助,您需要专门的环境。

4、Habitat 3.0+

Habitat是开发家庭助手的模拟器。Meta专注于渲染室内场景和在其中建模人物。

在3.0版本中,开发人员添加了社交互动。模拟包括家具和数字人物(化身),他们行走、干扰工作或要求提供服务。该模拟器允许您模拟数十亿个经验步骤,因此机器人学会与主人互动并理解手势。这是开发服务机器人(老年人护理、酒店配送)的理想平台。

Meta展示了在Habitat 3.0中,机器人助手如何学会与人一起打扫房间,协调其动作以避免阻挡通道。与真实展厅的测试相比,这将社交技能培训时间减少了100倍。

5、Unity Robotics Hub

Unity Robotics Hub允许您将ROS 2(机器人的标准操作系统)集成到高性能图形环境中。主要优势是人机交互(HMI)。在Unity中,建模人如何对机器人动作做出反应以及设置控制界面或操作员的VR模拟器更容易。

沃尔沃汽车使用Unity为其生产线创建准确的数字孪生。沃尔沃不是在真实传送带上停止测试,而是在虚拟环境中进行测试。这使其能够识别对人员安全的潜在风险并优化工作区域。

这种方法缩短了新车型上市时间,因为人员培训和机器人设置与真实生产线的建设同时进行。

6、2026年趋势

模拟已成为创造和改进自身的动态环境。以下是今年改变企业游戏规则的三个主要趋势:

6.1 基础模型

以前,工程师花费数周时间手动编写每个场景:"如果盒子掉了怎么办"或"如何对跑开的孩子做出反应"。2026年,大型模型(如GPT-5和Gemini 2.0)接管了这一工作。

工作原理:您输入文字命令:"生成500个雨夜加油站的紧急情况。"AI本身创建3D场景,安排物体并编程异常。

Waymo在其模拟器中使用生成模型创建"数字幻觉"。AI本身对道路上的紧急情况进行建模,例如,如果动物跑上道路且路灯同时熄灭,汽车将如何表现。这使Waymo积累了超过200亿英里的虚拟经验,使其自动驾驶汽车更安全。

6.2 神经渲染(NeRF/高斯溅射)

今天,高斯溅射技术允许您将普通智能手机拍摄的视频转变为高保真数字模拟。

工作原理:经理拿着手机在车间走动,神经网络生成房间的照片级真实感渲染,包括所有反射和纹理。

NVIDIA和西门子已将其平台结合起来创建"全保真"数字孪生。西门子工程图中的任何更改都会自动反映在照片级真实感的Omniverse模拟中,考虑到物理定律(材料、光线、重力)。

感谢这一点,公司可以在第一块石头铺设之前创建其工厂的完整副本。测试机器人和传送带的数百万种布局选项,以避免真实世界中的昂贵重新设计。

6.3 多智能体编排

我们现在看到从训练单个"智能"机器人转向管理作为单一有机体工作的整个蜂群的转变。

工作原理:数百架无人机或仓库叉车同时在模拟器中。它们学会相互协商:谁将首先通过十字路口,如何分割大订单以避免造成交通堵塞。这是真正可扩展性的关键。

亚马逊在NVIDIA Omniverse中使用多智能体模拟来编排数千台自主移动机器人(AMR)。通过"数字压力测试",公司优化了机器人在狭窄过道中的机动性,使其能够将仓库吞吐量提高30%并加快产品分拣。

7、结束语

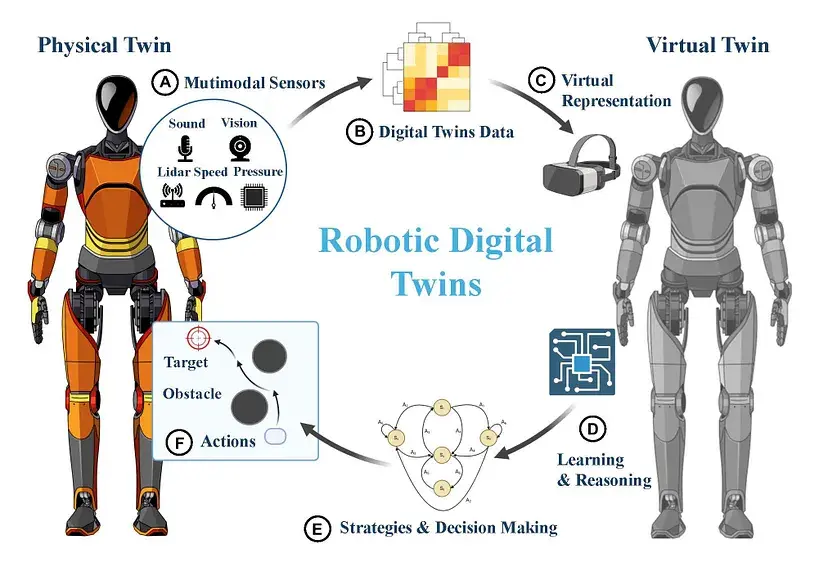

2026年,数字孪生概念是机器"生命支持"的标准。以前,公司在谁的伺服电机更快、谁的电池持续时间更长方面竞争。今天,"硬件"已成为可以购买或租赁的商品。真正的附加值现在在于数据和学习速度。

最终预测很简单:在未来几年,市场上的赢家不是那个用最强钛合金建造"最好"机器人的人,而是那个为其训练创造最先进虚拟环境的人。

未来属于那些能够在竞争对手将他们的机器投入第一次真实测试之前,在模拟中让他们的机器人经历十亿种场景的人。

原文链接:Top of embodied AI simulators in 2026

汇智网翻译整理,转载请标明出处