本地运行AI快速指南

本指南适用于所有人——从拥有旧笔记本电脑的人到正在构建专业本地AI工作站的人。设置方式不同。但这样做的原因大多是相同的。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

Ollama是最流行的本地运行AI的工具之一,在2026年GitHub星标数突破了10万。这个数字说明了一件事:这不再是小众的东西了。人们正在自己的机器上运行真正的AI模型,用于真正的工作,而不需要按token付费给任何人。

本指南适用于所有人——从拥有旧笔记本电脑的人到正在构建专业本地AI工作站的人。设置方式不同。但这样做的原因大多是相同的。

1、为什么要费心在本地运行AI

最诚实的原因是隐私。

当你使用ChatGPT或任何云端AI时,你的提示会发送到别人的服务器。你在信任他们的政策、他们的安全性,以及他们明年决定如何处理这些数据。如果你正在处理合同、客户笔记、健康文档、内部代码或任何你不会公开发布的内容,这是一个真正的问题。

第二个原因是成本。

ChatGPT Plus订阅每月20美元。如果你大量使用AI并在本地运行,这笔钱就留在你的口袋里了。对于一个50人的团队使用云端AI,仅基本访问每年就需要12,000美元。

第三个原因是它现在确实能用了。

像Qwen3、Llama 4、DeepSeek和Gemma 3这样的模型可以在消费级硬件上舒适地运行,并很好地处理大多数日常任务:总结文档、编写代码、起草电子邮件、回答关于你文件的问题。对于本地工作,你不再需要太多妥协。

还有离线这个角度。

没有互联网,没有速率限制,没有服务中断。如果你旅行、在低连接区域工作,或者只是讨厌依赖正常运行时间,本地AI可以完全解决这个问题。

2、开始之前:了解你的机器能处理什么

运行本地AI最重要的硬件指标不是你的CPU,甚至不是你有多少RAM。而是VRAM,你显卡上的内存。这是模型在运行时实际存放的地方。如果模型装不下,它会溢出到常规RAM中,速度会慢到令人痛苦,有时是每秒2-3个单词,而不是可用的每秒30-40个。

快速检查你的机器能实际运行什么:访问CanIRun.ai。它通过你的浏览器检测你的GPU、CPU和RAM,并显示你的机器可以处理哪些模型。无需注册。

现在,具体的设置:

3、假如,你有一台普通笔记本电脑

适合大多数人。一台旧笔记本电脑、一台预算机器、任何有8-16GB RAM且没有独立GPU的设备。

你仍然可以在本地运行AI。你只需要选择合适的模型大小。

8GB RAM,坚持使用3B到7B参数范围的模型。这些模型小、快,对大多数任务来说出人意料地强大。像Phi-4 Mini或Mistral 7B这样的模型在这里运行良好,加载时只需要大约4-6GB。

16GB RAM,你可以升级。Gemma 3 12B是一个不错的选择。它很好地处理一般聊天,阅读文档,写作清晰,不会把你的机器推到极限。

使用工具 - LM Studio。

从lmstudio.ai下载。它适用于Windows、Mac和Linux。无需命令行,无需设置麻烦。你打开应用,搜索模型,下载它,然后开始聊天。它自动检测你的硬件,如果有GPU就使用GPU,如果没有就回退到CPU。对于只是想要能用的东西的笔记本电脑用户,这是正确的起点。

另外,GPT4All是另一个选择,对初学者更友好,尽管模型选择较少。

一个重要说明:在只有CPU的笔记本电脑上,响应会更慢,也许每秒3-8个单词。这用于起草和阅读是可以的,但不适合快速来回聊天。从较小的模型(3B或4B)开始会给你明显更流畅的体验。

4、假如,你有一台配备不错GPU的台式PC

适合拥有游戏PC或配备中端到高端NVIDIA GPU的台式机的人。

这就是事情真正变得好的地方。如果你有RTX 3060 12GB或更好的显卡,你可以以真正的速度运行7B和8B模型,大约每秒30-50个token。Llama 3.3 8B、DeepSeek Coder、Mistral 7B和Qwen3 7B都能在这里毫不费力地运行。

需要注意的一件事:不要购买8GB VRAM的RTX 4060 Ti。一旦模型加载并且上下文增长,它很快就会填满。同一张卡的16GB版本值得额外的成本。

有了RTX 3090或4090(24GB VRAM),你可以舒适地运行30B模型,甚至可以尝试70B模型的压缩版本。这曾经是需要专用服务器硬件的领域。

使用工具 - Ollama。

Ollama是一个命令行工具,使运行模型变得尽可能简单。一次安装,然后一条命令:

ollama run llama3.3

这会拉取模型并开始聊天。它还在端口11434上运行本地API服务器,这意味着你构建或使用的任何应用都可以像连接到OpenAI的API一样连接到它,只是指向你自己的机器。

如果你想在Ollama之上有一个聊天界面,Open WebUI给你一个基于浏览器的界面,运行良好,感觉像一个合适的聊天应用。

5、假如,你想走得更远

适合开发者、高级用户、为小团队运行AI的人,或者任何想要正确运行更大模型的人。

这里有几条路径:

5.1 Apple Silicon Macs

Mac Mini M4、MacBook Pro M3/M4和Mac Studio使用统一内存,这意味着你的全部RAM可用于模型加载,没有GPU VRAM限制。16GB的Mac Mini M4可以流畅运行14B模型。96GB的Mac Studio M3 Ultra可以同时在内存中保存多个模型。这目前是安静高效运行大型模型的最佳消费级选项之一。

5.2 专用Windows/Linux PC

RTX 4060 Ti 16GB是7B-13B范围的坚实入门点。32GB VRAM的RTX 5090(2025年初发布)可以运行高达405B的量化模型,尽管成本相当高。

5.3 为小团队提供AI服务

vLLM值得一看。它处理并发请求比Ollama好得多,支持多个用户访问同一个模型,并暴露OpenAI兼容的API。这需要更多的设置工作,但如果不止一个人需要访问,这就是正确的工具。

模型格式说明: 你经常会在Hugging Face上看到标有GGUF的文件。这些是预压缩的模型版本,设计用于在消费级硬件上运行。选择GGUF文件时,Q4或Q5版本在大小和质量之间取得了良好的平衡。Q8更接近原始模型,但需要更多内存。

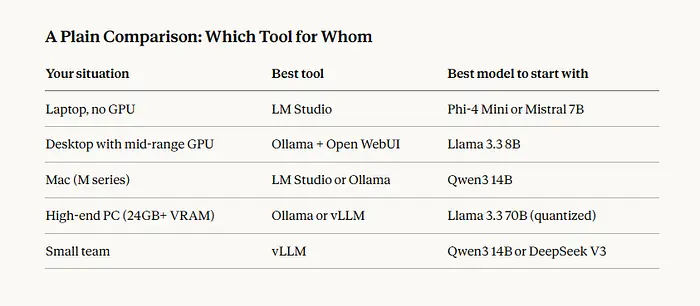

6、简单对比:哪种工具适合谁

7、本地AI不擅长什么

要现实地看待局限性。本地模型对大多数日常任务来说很好。在复杂推理、非常长的文档或需要最新信息的任务上,它们并不总是像GPT-4o或Claude那样敏锐。如果你需要在困难问题上得到绝对最好的答案,云端模型仍然有优势。

速度也有所不同。在没有GPU的笔记本电脑上,你会感受到缓慢。在有合适GPU的PC上,感觉正常。在像有大量内存的Mac Studio这样的设备上,它很快。

与云端AI不同,你需要自己处理更新。新版本的模型不会自动出现。你需要检查、下载和手动切换。

8、结束语

如果你不确定从哪里开始:检查CanIRun.ai看看你的机器支持什么,下载LM Studio(如果你更喜欢可视化界面)或Ollama(如果你习惯使用终端),选择一个7B-8B范围的模型开始,运行一次对话。如果它对你的用例有效,就继续使用。如果你想要更多性能,你会知道该升级什么。

这就是整个设置。它不需要很复杂。

原文链接: The Clear Setup Guide to Run AI Locally on Your Machine in 2026

汇智网翻译整理,转载请标明出处