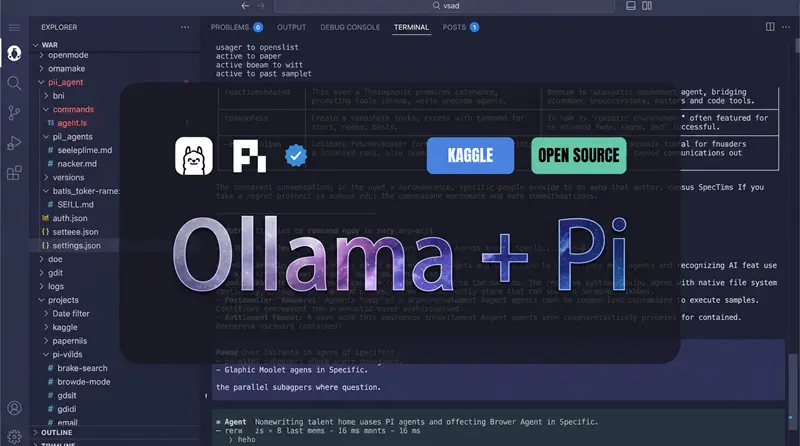

Ollama+Pi 搭建本地开发环境

如何安装 Ollama、配置 Pi、运行本地 LLM、添加技能和扩展,并构建 Claude Code 和 Codex 的替代方案。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

如果你想用 Ollama 进行编程,在自己的机器上运行本地 LLM,并构建一个实用的开源 Claude Code 和 Codex 替代方案,Pi 是最灵活的入门工具之一。与其围绕专有 AI 平台构建工作流,你可以组合 Pi、Ollama、技能、扩展和本地模型,创建一个私密、模块化且经济的开发者环境。

这不是要假装本地模型在每个方面都优于托管模型。那是错误的。更有力且更有用的说法更窄:对于许多真实的开发者工作流,Pi 加 Ollama 已经足够好来提升生产力,尤其是在编程、仓库分析、Shell 任务、摘要和结构化自动化方面。

1、什么是 Ollama,为什么开发者在使用它?

Ollama 是一个本地运行时,用于在你自己的机器上运行大语言模型。它下载模型、在本地提供服务,并让你通过 CLI 和本地 API 与模型交互。对开发者来说,这很重要,因为它使得构建本地 AI 工作流成为可能,而无需将每个请求发送到托管提供商。

Ollama 吸引注意力的原因很简单:

- 它降低了运行本地模型的门槛

- 它为开发者提供了一种直接的方式来测试 Qwen 和 Gemma 等模型

- 它自然地融入基于终端的工作流

- 它为构建自托管的 AI 编程工具提供了基础

如果有人在搜索如何使用 Ollama 进行编程,真正的答案不仅仅是"安装它然后运行一个提示"。有用的答案是把它连接到一个能真正在你的项目内操作的工具上。这就是 Pi 发挥作用的地方。

2、什么是 Pi,它如何与 Ollama 配合?

Pi 在这个设置中充当编程代理 CLI 和编排层。你不再将本地模型当作原始聊天机器人使用,而是通过一个代理接口来使用它,这个接口可以检查文件、编辑代码、运行 Shell 命令,以及使用技能和扩展。

这个区别很重要。

很多开发者安装了本地 LLM,运行了几个提示,然后得出结论说本地 AI 令人失望。在很多情况下,问题不在于模型本身。问题在于缺少工作流结构。Pi 通过以下方式添加了这种结构:

- 基于终端的代理工作流

- 文件和 Shell 交互

- 通过配置进行模型路由

- 支持技能和扩展

- 围绕本地模型构建可重用的 AI 编程工作流的路径

如果 Ollama 是本地推理层,Pi 就是将它变成真正开发者工具的那一层。

3、为什么使用 Pi 和 Ollama

而不是只用 Claude Code 或 Codex?

很多开发者都在寻找 Claude Code 的替代方案或 Codex 的开源替代品。这种搜索通常源于四个关注点:

- 订阅成本

- 隐私和控制

- 供应商依赖

- 对更可定制工作流的需求

Pi 和 Ollama 不能解决所有问题。它们不会在每个场景中都取代最强大的专有工具。但它们确实解决了一个重要问题:它们让你可以构建一个端到端可控的本地优先 AI 编程工作流。

这意味着:

- 你的模型可以在本地运行

- 你的工作流不绑定于一个托管平台

- 你的设置可以通过技能、扩展和包来演进

- 你的成本更可预测

- 你的工具可以与你自己的工程流程对齐

这是一个真实的运营优势,而不是意识形态上的。

4、如何安装 Pi

Pi 通过 npm 安装:

npm install -g @mariozechner/pi-coding-agent

安装完成后,你可以直接启动 Pi:

pi

对于托管提供商,Pi 支持登录和认证流程。但对于使用 Ollama 的本地设置,重要的部分不是登录。重要的是通过 ~/.pi/agent/models.json 将 Pi 配置为使用本地提供商。

这是任何搜索 Pi CLI 设置的人的第一要点:安装很简单,但配置才是真正工作流的起点。

5、如何安装 Ollama

Ollama 是下载和服务本地模型的组件。在 Linux 上的典型安装如下:

curl -fsSL https://ollama.com/install.sh | sh

安装完成后,你可以通过直接运行模型来验证一切正常:

ollama run gemma4:e4b

这反映了正常的 Ollama 工作流:选择一个模型,如果缺少就由 Ollama 拉取,然后在本地运行。

对于搜索如何安装 Ollama 或如何用 Ollama 运行本地模型的人,有用的顺序是:

- 安装 Ollama

- 直接运行一个模型来确认它工作正常

- 然后才将它连接到 Pi 等更高级的工具

这个顺序可以避免故障排除时的混乱。

6、如何配置 Pi 使用 Ollama

这是工作流中价值最高的部分,因为它捕捉了很多人容易出错的环节。

Pi 一旦知道如何与你的 Ollama 实例通信,就变得有用。在你的设置中,首先启动 Pi 配置流程:

ollama launch pi --config

核心思路很简单:Pi 不是硬编码到单个提供商的。当配置为使用 Ollama 作为模型后端时,它就变成了一个本地编程助手。

一个兼容性导向的提供商配置看起来像这样:

{

"providers": {

"ollama": {

"baseUrl": "http://localhost:11434/v1",

"api": "openai-completions",

"apiKey": "ollama",

"compat": {

"supportsDeveloperRole": false,

"supportsReasoningEffort": false

},

"models": [

{

"id": "qwen3.5:14b",

"reasoning": true

}

]

}

}

}

这个细节很重要。它让这篇文章比通用的"安装然后祈祷"教程更有用,因为真实的本地工作流通常在配置环节失败,而不是安装环节。

7、如何用本地 Ollama 模型启动 Pi

一旦 Ollama 运行且 Pi 配置就绪,工作流很简单:

- 启动 Ollama

- 确保你选择的模型可用

- 打开 Pi

- 选择模型

- 在你的仓库中工作

一个简单的示例如下:

pi

/model

select your prefered model

这就是本地 AI 编程工作流的核心。关键不仅是模型在本地运行,而是模型现在可以通过一个能够检查文件、与你的仓库交互并通过 Shell 命令工作的接口来使用。

这就是它对实际工程工作有意义的原因。

8、如何在 Pi 中添加技能

Pi 的技能系统支持自包含的能力包,包括工作流指令、辅助脚本和专门的文档。常见的技能查找路径包括:

~/.pi/agent/skills/~/.agents/skills/.pi/skills/.agents/skills/

这很重要,因为搜索 Pi 技能或使用 Pi 构建自定义 AI 工作流的人不只是寻找安装步骤。他们想要围绕自己的任务塑造系统的方法。

可以像这样添加一个现成的技能集合:

git clone https://github.com/badlogic/pi-skills ~/.pi/agent/skills/pi-skills

或者项目级别的:

git clone https://github.com/badlogic/pi-skills .pi/skills/pi-skills

你也可以显式加载一个技能:

pi --no-skills --skill ./.agents/skills/my-skill

这让 Pi 不仅仅是一个通用的模型前端。它变成了一个面向任务的开发者环境。

9、如何在 Pi 中添加扩展

扩展是 Pi 比基本的本地模型 Shell 更有用的主要原因之一。

Pi 扩展可以:

- 订阅生命周期事件

- 注册可调用的工具

- 添加自定义命令

- 扩展终端行为

典型的扩展路径包括:

~/.pi/agent/extensions/.pi/extensions/

你可以像这样直接测试一个扩展:

pi --extension ./my-extension.ts

这部分很重要,因为搜索 Pi 扩展或自定义 AI 编程代理工具的开发者通常不只是寻找设置指南。他们想要在工作流之上进行构建。

10、如何在 Pi 中安装基于包的附加组件

Pi 还支持基于包的附加组件,这使得工作流在项目级别更具可复现性。

示例包括:

pi install npm:@foo/bar@1.0.0

pi install git:github.com/user/repo@v1

pi install https://github.com/user/repo

pi install ./relative/path/to/package

pi list

pi update

这值得保留,因为它表明 Pi 不仅仅是一个本地聊天包装器。它支持一个可以扩展为可复用的项目级工具的包管理模型。

如果你想在多个仓库之间维护相同的 AI 工作流或与其他开发者分享,这很有用。

11、一个实用的本地 AI 工作流

一个实用的设置看起来像这样。

11.1 基础运行时

- Pi 全局安装

- Ollama 本地安装

models.json指向本地 Ollama 提供商

11.2 本地模型

- 一个更快的日常模型

- 一个更强的备用模型

11.3 技能

- 研究

- 摘要

- 代码审查

- Shell 或运维辅助

11.4 扩展

- 网页搜索

- 文件工具

- 编辑器集成

- 需要时的提供商适配器

11.5 Pi 和 Ollama 工作流示例

一个清晰的工作流示例从这样开始:

pi

在 Pi 内部,一个有用的提示可能是:

Analyze this repository, explain the service boundaries, and propose a cleaner Docker Compose setup for local development.

12、Pi 和 Ollama 的最佳本地模型

不要过度宣称。

实用的规则很简单:使用在你的机器上仍能提供可接受延迟的最大本地模型。对于日常工作,一个更小更快的模型通常比一个太大而无法快速迭代的大模型更有用。

这是对搜索以下内容的读者来说重要的信息:

- Ollama 编程最佳模型

- 开发者最佳本地 LLM

- Qwen vs Gemma 编程

有用的建议不是"总是使用最大的模型"。有用的建议是:

- 日常交互工作使用更快的模型

- 当任务值得承受延迟时使用更强的模型

- 针对工作流吞吐量优化,而不仅仅是原始能力

这就是本地模型变得实用而非令人沮丧的方式。

13、Pi vs Claude Code vs Codex

Claude Code 和 Codex 风格的工具围绕专有生态系统构建,通常提供更精良的托管体验。Pi 加 Ollama 给你一个更灵活、本地优先、以开源为中心的工作流,对模型、配置、工具和成本有更强的控制力。

Pi 和 Ollama 更强的方面

- 隐私

- 成本控制

- 可移植性

- 可组合性

- 对单一供应商的依赖更少

较弱的方面

- 前沿级推理一致性较低

- 托管生态系统不够精良

- 设置工作更多

- 性能更直接地取决于你的硬件

这是诚实的比较。它之所以有用是因为它很平衡。过度夸大开源的优势反而会让文章变弱而非变强。

14、本地 AI 编程工作流值得吗?

是的,对很多开发者来说是值得的。

不是因为本地工具普遍更好。它们不是。本地工作流值得是因为它改变了运营模式。你不再完全依赖一个专有接口,而是获得了一个你可以配置、检查和演进的技术栈。

如果你关心以下方面,这尤其有价值:

- 保持贴近你的终端和仓库

- 出于隐私或成本原因使用本地模型

- 用技能和扩展构建可复现的工作流

- 减少对基于订阅的 AI 工具的依赖

这才是真正的价值主张。

15、结束语

如果你在寻找一种使用 Ollama 进行开发、运行本地 LLM 进行编程,并构建 Claude Code 和 Codex 的开源替代方案的方法,Pi 加 Ollama 的组合是一个可靠的起点。它为你提供了本地运行时、面向代理的 CLI、对技能和扩展的支持,以及将本地模型变成真正开发者工具的实用方式。

重要的不是开源工具在每个基准测试中都获胜。重要的是当它们被组合成一个可用的系统时,已经能够支持真实的工程工作。Pi 和 Ollama 为你提供了这样一个系统。

原文链接:Ollama for Developers: How to Build a Local AI Coding Workflow with Pi and Open-Source Tools

汇智网翻译整理,转载请标明出处