Mamba 3:AI架构的真正变革

Mamba-3不仅仅是增量改进。它反映了一个更深层的转变——转向能够在现实世界系统中大规模运行的推理优化模型。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI模型价格对比 | AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

多年来,Transformer一直主导着现代AI领域。GPT、Claude和LLaMA等模型都建立在能够一次性处理整个序列的注意力机制之上。这种方法在语言理解、推理和生成方面实现了突破。

但一种新的架构正在获得强劲的发展势头:Mamba。

它不仅仅是另一个模型,更代表了一种在序列建模、记忆和效率方面完全不同的思维方式。

1、核心区别

从高层次来看:

- Transformer对所有token使用注意力机制

- Mamba使用压缩的内部状态

Transformer通过将每个token与序列中的所有其他token进行比较来处理。这产生了一个二次复杂度问题:O(n²)

随着序列长度的增长,计算量和内存使用量会迅速增加。

Mamba采用了不同的方法。它不重新访问所有先前的token,而是维护一个随时间演变的动态内部状态:O(n)

这意味着它的复杂度是线性的,使其在处理长序列时效率显著更高。

2、Transformer的工作原理

Transformer依赖自注意力机制:

- 每个token都与其他所有token进行关联

- 模型构建序列的完整上下文映射

- 记忆在推理期间通过KV缓存显式存储

优势:

- 强大的推理能力和上下文学习能力

- 对过去token的精确检索

- 在许多任务中具有高准确度

局限性:

- 处理长序列代价高昂

- 内存占用大(KV缓存随上下文增长)

- 大规模推理速度较慢

3、Mamba的工作原理

Mamba基于状态空间模型(SSM)。它不使用注意力机制,而是使用一个随新token到来而更新的循环状态。

核心思想:

模型不会记住所有内容。它选择性地将信息压缩到一个隐藏状态中。

优势:

- 线性复杂度

- 恒定的内存使用(无需KV缓存)

- 极快的推理速度

- 在长序列上表现强劲

局限性:

- 显式检索能力较弱

- 在少样本提示中效果较差

- 推理能力仍落后于顶级Transformer模型

3.1 关键创新:选择性状态空间

早期的SSM之所以表现不佳,是因为它们对所有输入一视同仁。

Mamba引入了选择性机制:

- 重要的token被保留

- 无关的token被丢弃

这使得Mamba具有类似注意力机制的行为,但不需要完整的计算成本。

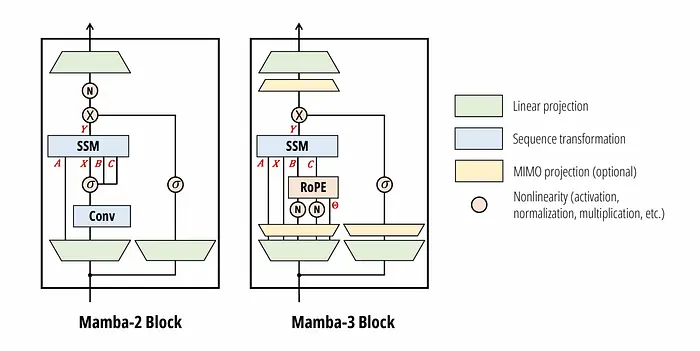

3.2 Mamba-2:理论桥梁

Mamba-2改进了数学基础:

- 统一了注意力机制和状态空间模型的视角

- 更好的训练稳定性

- 改进的可扩展性

这一版本使Mamba在实践中更具与Transformer竞争的能力。

4、Mamba-3:推理优先设计

Mamba-3代表了一次重大转变。它不再针对训练进行优化,而是专为实际部署而设计。

4.1 更强的循环机制

Mamba-3引入了更具表达力的循环机制(指数-梯形更新),使模型能够随时间捕获更复杂的模式。

4.2 复数状态

Mamba-3使用复数代替实值状态。

这改善了:

- 记忆表示

- 时间动态

- 长上下文追踪

4.3 MIMO(多输入多输出)

多个状态通道并行运行。

结果:

- 更高的准确度

- 解码延迟不增加

这很不寻常。通常,更多的计算会导致推理变慢。Mamba-3通过利用未充分使用的GPU资源避免了这种权衡。

5、为什么Mamba-3很重要

AI领域正在发生变化。

瓶颈不再是训练,而是推理。

现代系统需要:

- 实时响应

- 长上下文处理

- 持续生成(智能体、编码系统、模拟)

Mamba-3直接针对这些需求:

- 更快的解码

- 更低的内存使用

- 更好的可扩展性

在基准测试中,即使是小型的Mamba-3模型也能在速度上超越同等规模的Transformer模型,尤其是随着序列长度的增加。

6、权衡:检索 vs 压缩

Transformer显式存储信息。

Mamba压缩信息。

这导致了一个关键的权衡:

- Transformer擅长精确检索

- Mamba擅长高效表示

对于需要精确回忆的任务,Transformer仍然占据优势。

7、未来:混合架构

最可能的方向不是替代,而是结合。

混合模型可以:

- 使用注意力机制进行检索

- 使用Mamba进行高效序列建模

这使得系统能够平衡:

- 准确度

- 速度

- 内存使用

多个研究方向和早期系统已经朝着这种混合方法发展。

8、Mamba的优势领域

Mamba在以下方面特别有效:

- 长文档处理

- 流式数据处理

- 音频和语音建模

- 基因组学和生物序列

- 实时AI系统

- 基于智能体的架构

9、结束语

Transformer通过使上下文可访问来改变了AI。

Mamba通过使上下文高效来改变AI。

Mamba-3不仅仅是增量改进。它反映了一个更深层的转变——转向能够在现实世界系统中大规模运行的推理优化模型。

问题不再是Transformer是否会被取代。

真正的问题是,还需要多久,类Mamba架构就会成为每个严肃AI系统的标准组件。

原文链接:Mamba vs Transformer: The Real Shift in AI Architecture (2026)

汇智网翻译整理,转载请标明出处