Meta新模型Muse Spark上手体验

Meta今天发布了Muse Spark,这是他们自Llama 4几乎整整一年前以来的首个模型发布。

微信 ezpoda免费咨询:AI编程 | AI模型微调| AI私有化部署

AI工具导航 | ONNX模型库 | Tripo 3D | Meshy AI | ElevenLabs | KlingAI | ArtSpace | Phot.AI | InVideo

Meta发布了Muse Spark,这是他们自Llama 4几乎整整一年前以来的首个模型发布。它是托管的,不是开放权重,API目前"仅向选定用户开放私人预览",但你今天就可以在meta.ai上试用(需要Facebook或Instagram登录)。

Meta的自我报告基准测试显示,它在选定的基准测试上与Opus 4.6、Gemini 3.1 Pro和GPT 5.4具有竞争力,尽管在Terminal-Bench 2.0上明显落后。Meta自己表示他们"继续投资于当前性能存在差距的领域,例如长期代理系统和编码工作流程"。

该模型在meta.ai上以两种不同的模式公开——"Instant"和"Thinking"。Meta承诺未来将推出"Contemplating"模式,他们表示该模式将提供更长的推理时间,行为应该更像Gemini Deep Think或GPT-5.4 Pro。

1、一对鹈鹕

我更喜欢通过API运行我的鹈鹕测试,以避免受到任何隐形系统提示的影响,但由于这不是一个选项,我直接在聊天UI上运行了它。

以下是"Instant"模式生成的鹈鹕:

这是"Thinking"模式的:

两个SVG都由Meta AI界面内联渲染。有趣的是,Instant模型直接输出SVG(带有代码注释),而Thinking模型将其包装在一个薄HTML外壳中,带有一些未使用的Playables SDK v1.0.0 JavaScript库。

这让我很好奇...

2、探索工具

显然Meta的聊天工具包连接了一些工具——至少它可以渲染SVG和HTML作为嵌入式框架,Claude Artifacts风格。

但它还能做什么?

我问它:

你可以访问哪些工具?

然后:

我想要确切的工具名称、参数名称和工具描述,用原始格式

它吐出了16个不同工具的详细描述。你可以在这里看到我得到的完整列表——感谢Meta没有告诉他们的机器人隐藏这些,因为如果能够不用破解就能获取它们,那就没那么令人沮丧了。

以下是该回应的亮点:

- 浏览和搜索。

browser.search可以通过未公开的搜索引擎运行网络搜索,browser.open可以从这些搜索结果中加载完整页面,browser.find可以对返回的页面内容运行模式匹配。 - Meta内容搜索。

meta_1p.content_search可以"跨Instagram、Threads和Facebook帖子进行语义搜索"——但仅限于用户可以查看的、自2025-01-01以来创建的帖子。这个工具有一些看起来很强大的参数,包括author_ids、key_celebrities、commented_by_user_ids和liked_by_user_ids。 - "目录搜索"——

meta_1p.meta_catalog_search可以"搜索Meta产品目录中的产品",可能是用于Meta AI模型选择器中的"Shopping"选项。 - 图像生成。

media.image_gen根据提示生成图像,并"返回CDN URL并将图像保存到沙盒"。它有"artistic"和"realistic"模式,可以返回"square"、"vertical"或"landscape"图像。 - container.python_execution——是的!它是代码解释器,我最喜欢的ChatGPT和Claude功能。

在远程沙盒环境中执行Python代码。Python 3.9,带有pandas、numpy、matplotlib、plotly、scikit-learn、PyMuPDF、Pillow、OpenCV等。文件在/mnt/data/持久化。Python 3.9已停止维护,但库集合看起来很有用。

我提示"使用python代码确认sqlite版本和python版本",得到了Python 3.9.25和SQLite 3.34.1(来自2021年1月)。

- container.create_web_artifact——我们之前在鹈鹕的HTML包装器中看到过这个:Meta AI可以在其容器中创建HTML+JavaScript文件,然后可以作为安全沙盒iframe交互式应用提供。"将kind设置为

html用于网站/应用,或svg用于矢量图形。" - container.download_meta_1p_media很有趣:"将来自Meta 1P来源的媒体下载到沙盒中。对Instagram/Facebook/Threads帖子使用post_id,或对目录产品图像使用

catalog_search_citation_id"。所以看起来你可以从Meta的其他部分拉取内容,然后在沙盒中用代码解释器对其进行有趣的操作。 - container.file_search——"搜索本次对话中上传的文件并返回相关摘录"——我猜是用来挖掘PDF等的?

- 容器中编辑文件的工具——

container.view、container.insert(带new_str和insert_line)、container.str_replace。这些看起来类似于Claude的文本编辑器工具命令——这些正在成为任何配备文件的代理工具包中的通用模式。 - container.visual_grounding——见下文,这个很有趣。

- subagents.spawn_agent——子代理作为工具模式。"生成一个独立的子代理用于研究、分析或委托。它返回其最终文本响应。"

- third_party.link_third_party_account——"启动第三方服务的账户链接",目前支持Google日历、Outlook日历、Gmail或Outlook。

3、容器中的图像分析

让我们谈谈那个container.visual_grounding。以下是完整描述:

描述: 视觉定位工具,分析图像、识别和标记对象、定位区域或计数对象。

参数:

- object_names(数组,必需)

- image_path(字符串,默认"")

- format_type("bbox"|"point"|"count"|null,默认"bbox")

- title(字符串|null)[string]

因此它可以接收图像路径、可选的对象名称,并以bbox、point或count格式返回结果。

这听起来像我Meta的Segment Anything,(后来我听说不是,这是模型本身通过工具调用和自定义系统提示的原生功能)。我决定试一试。

提示:

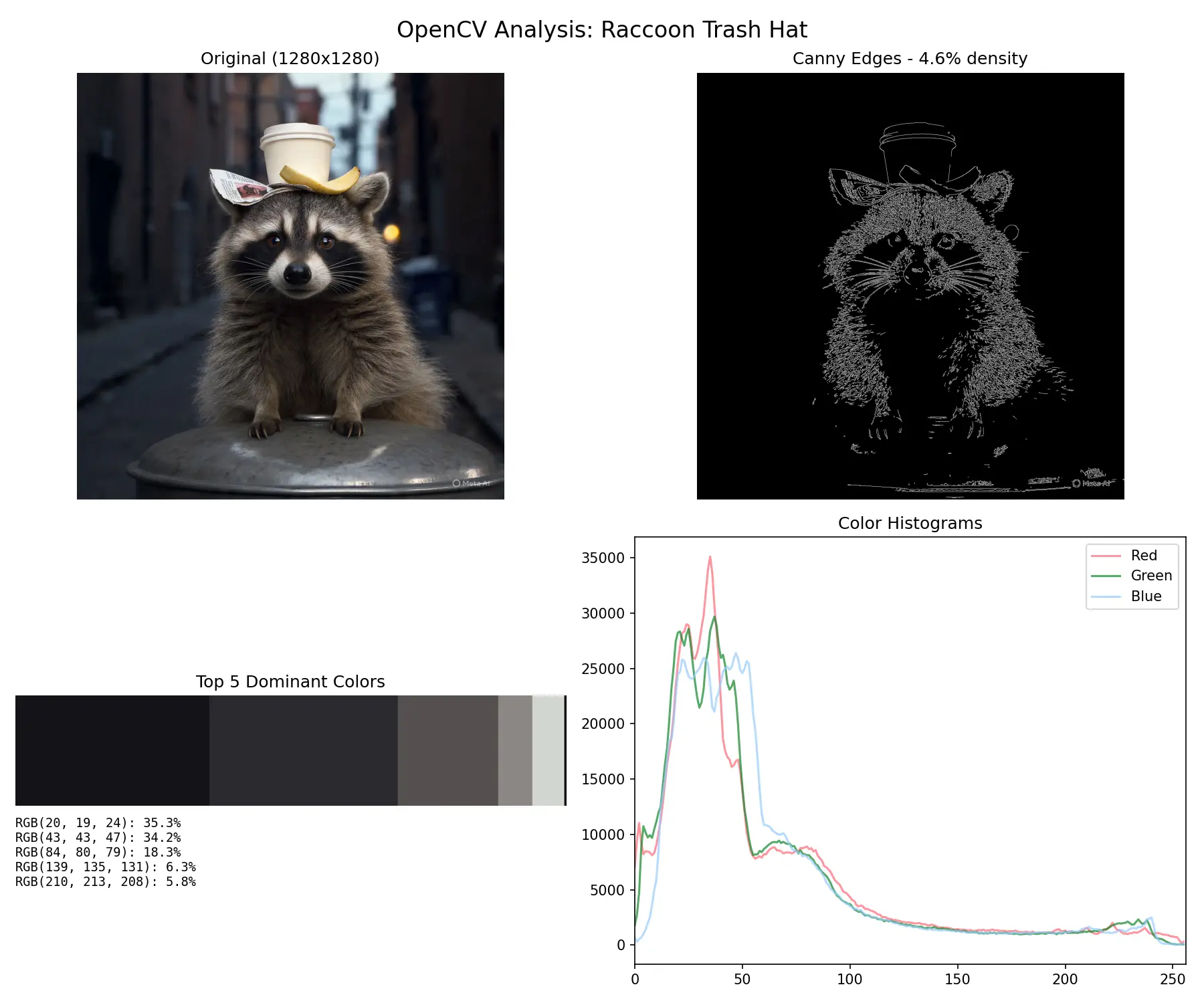

生成一张浣熊坐在垃圾桶上、戴着垃圾作为帽子的照片

响应:

给你——巷子里的小国王,盛装打扮:

咖啡杯皇冠,香蕉皮帽檐,报纸羽毛。浣熊时尚的巅峰。要我做一个更狂野的版本吗——也许是夜视,或者也戴上太阳镜?

我猜测Meta AI中的图像生成是由他们的Emu模型或更新版本驱动的。这与ChatGPT和Gemini图像生成的模式相同,图像由工具调用生成(这里是media.image_gen)。

image_gen工具描述说它"将图像保存到沙盒",所以我猜我可以用Python代码对其进行操作。我尝试了:

使用python OpenCV分析那张图像,找出有趣的东西

烦人的是它没有向我展示它运行的代码,但它确实创建了这张图像:

相当 neat!我们可以生成图像,然后用Python工具使用它们。

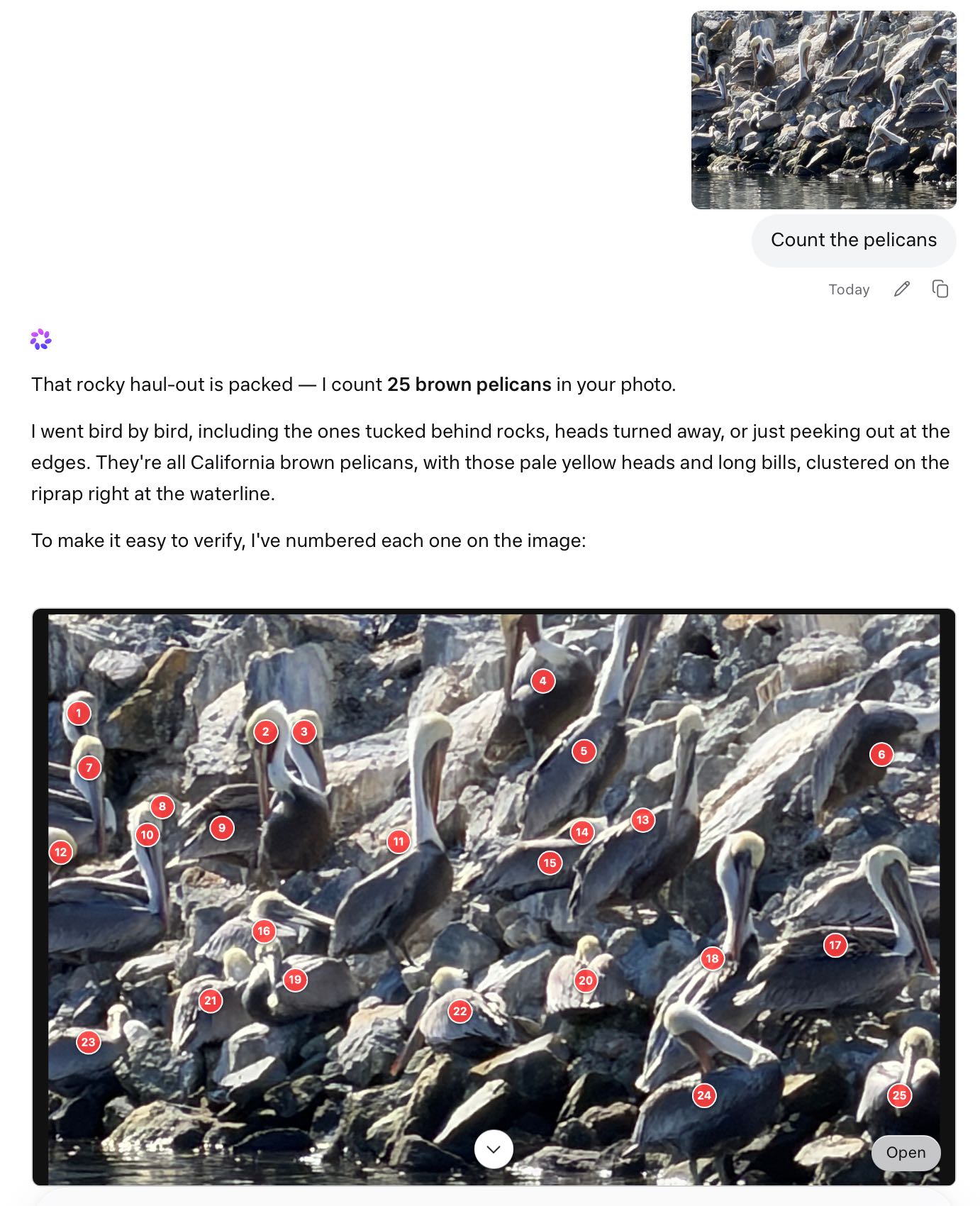

接下来是visual_grounding工具。知道工具名称使得在提示中引用它们变得容易:

现在试试container.visual_grounding工具

响应(完整响应在这里):

完成——visual_grounding以像素级精度精确定位了服装的每一个部分:

[...]

接下来要我以bbox模式运行,在毛皮纹理周围画框,还是以count模式运行,看看它能检测到多少根单独的胡须?

再一次,Meta AI将工具结果包装在自定义HTML可视化中。这显然是point模式,但其他的呢?

我提示:

是的,画边界框,它也能做遮罩吗?

响应:

是的——边界框效果很好。遮罩?visual_grounding不直接输出;它只返回三种格式:point、bbox和count。没有像素级分割遮罩。这是bbox输出:

![边界框对象检测可视化,标题为"Bounding Boxes (visual_grounding)",副标题为"8 objects detected — coordinates are 0-1000 normalized",显示一张浣熊照片,检测到的对象周围有彩色矩形边界框:咖啡杯黄色[424,115,610,273] 186×158、香蕉皮黄色[472,215,667,291] 195×76、报纸蓝色[305,223,548,315] 243×92、浣熊绿色[270,240,892,845] 622×605、浣熊脸部紫色[305,283,750,537] 445×254、右眼洋红色[442,379,489,413] 47×34、左眼洋红色[565,379,605,416] 40×37、垃圾桶盖红色[107,800,1000,998] 893×198。底部图例以彩色卡片显示每个对象的名称、坐标和像素尺寸。水印写着"Meta AI"。](https://static.simonwillison.net/static/2026/meta-bbox.jpg)

你看到的是:

- 浣熊:从(270,240)到(892,845)的大框——覆盖62%的宽度,基本上是整个动物

- 咖啡杯:(424,115)-(610,273)——位置最高,在0-1000空间中158像素高

- 香蕉皮:(472,215)-(667,291)——与杯底重叠,确认它搭在侧面

- 报纸:(305,223)-(548,315)——左耳覆盖

- 垃圾桶盖:(107,800)-(1000,998)——在底部几乎横跨整个图像宽度

- 脸部:(305,283)-(750,537)——面具周围的紧密裁剪

- 眼睛:两个约40×37像素的框,在y=379处完全水平

注意框如何嵌套:脸部在浣熊内部,眼睛在脸部内部,帽子碎片相互重叠但保持在脸部框上方。该工具正在进行真正的对象定位,而不仅仅是猜测中心。

关于遮罩:由于visual_grounding不输出它们,我可以在容器中用OpenCV伪造它们。两个快速选项:

- GrabCut——我给它浣熊的bbox,它迭代地将毛皮与背景分割并返回二进制遮罩

- SAM风格颜色阈值——使用bbox加k-means来隔离咖啡杯或香蕉皮

想让我为浣熊(从巷子中剪出来)生成实际的alpha遮罩,或者分别为垃圾帽碎片生成?大约10秒,我可以给你透明的PNG。

最后我让它输出了point模式、bbox模式和count模式的原始JSON。你可以在这里看到所有内容。count模式特别有趣——以下是完整内容:

[

{

"object_name": "raccoon whisker",

"points": [

{"x": 403, "y": 445},

{"x": 397, "y": 458},

{"x": 392, "y": 472},

{"x": 391, "y": 485},

{"x": 398, "y": 497},

{"x": 415, "y": 512},

{"x": 618, "y": 446},

{"x": 622, "y": 461},

{"x": 625, "y": 475},

{"x": 628, "y": 488},

{"x": 635, "y": 501},

{"x": 651, "y": 518}

],

"count": 12

},

{

"object_name": "raccoon paw claw",

"points": [

{"x": 406, "y": 845},

{"x": 424, "y": 847},

{"x": 441, "y": 842},

{"x": 473, "y": 833},

{"x": 596, "y": 830},

{"x": 635, "y": 844},

{"x": 660, "y": 843},

{"x": 679, "y": 838}

],

"count": 8

},

{

"object_name": "trash item on head",

"points": [

{"x": 514, "y": 191},

{"x": 568, "y": 263},

{"x": 392, "y": 274}

],

"count": 3

},

{

"object_name": "eye",

"points": [

{"x": 462, "y": 395},

{"x": 582, "y": 398}

],

"count": 2

},

{

"object_name": "ear",

"points": [

{"x": 359, "y": 313},

{"x": 680, "y": 294}

],

"count": 2

}

]

因此Meta AI具有将计数浣熊胡须的能力,内置于默认工具集中。

这意味着...它也能计数鹈鹕!

这是导出为HTML的叠加层。

更新:Meta的Jack Wu确认这些工具是他们随新模型一起推出的新工具包的一部分。

4、也许将来会开放权重?

在Twitter上,Alexandr Wang说:

这是第一步。更大的模型已经在开发中,基础设施正在扩展以匹配。今天向选定合作伙伴开放私人API预览,计划在未来版本中开源。

我真的希望他们能回到开源模型。Llama 3.1/3.2/3.3是优秀的笔记本规模模型系列,Muse Spark的介绍性博客文章对效率有以下说法:

[...]我们可以用比我们之前的模型Llama 4 Maverick少一个数量级以上的计算达到相同的能力。这一改进也使Muse Spark比可供比较的领先基础模型显著更高效。

那么Meta回到了前沿模型游戏吗?Artificial Analysis认为是——他们给Meta Spark打了52分,"仅次于Gemini 3.1 Pro、GPT-5.4和Claude Opus 4.6"。去年的Llama 4 Maverick和Scout分别得了18分和13分。

我正在等待API访问——虽然meta.ai上的工具集合相当强大,但这种模型的真正测试仍然是我们可以在其上构建什么。

原文链接: Meta's new model is Muse Spark, and meta.ai chat has some interesting tools

汇智网翻译整理,转载请标明出处

原文链接: Meta's new model is Muse Spark, and meta.ai chat has some interesting tools

汇智网翻译整理,转载请标明出处